Kurzfassung

Deutschland hat die EU-Deadline am 2. August 2025 zur Benennung einer nationalen KI-Aufsichtsbehörde verpasst. Damit fehlt vorerst die zentrale Stelle, die KI-Systeme überwacht, Beschwerden annimmt und Regeln des AI Act durchsetzt. Unternehmen, Verwaltungen und Nutzer stehen in einer Übergangsphase ohne klare Anlaufpunkte. Mehrere Organisationen mahnen Tempo an. In diesem Überblick ordnen wir Lage, Rechtsrahmen und Folgen ein – und zeigen, wie die nationale KI-Aufsichtsbehörde jetzt schnell und sinnvoll aufgebaut werden könnte.

Einleitung

Die Uhr war abgelaufen, doch die Ernennung blieb aus: Deutschland hat die Frist verpasst, eine zentrale Aufsichtsbehörde für den EU-AI-Act zu benennen. Das ist mehr als ein bürokratisches Detail. Es betrifft jeden, der KI nutzt, baut oder reguliert. Vom Start-up mit Chatbot bis zum Krankenhaus mit Diagnosesoftware. Was folgt, ist eine Phase der Unsicherheit – aber auch eine Chance. Wenn Politik und Behörden jetzt klug handeln, kann der Aufbau gelingen, ohne Innovation zu bremsen.

Was das Fristversäumnis bedeutet

Die EU-Verordnung über Künstliche Intelligenz (AI Act) verpflichtet alle Mitgliedstaaten, bis zum 2. August 2025 nationale Stellen zu benennen. Diese Behörden überwachen den Markt, notifizieren Prüfstellen und sind Anlaufpunkt für Bürgerinnen und Bürger. Deutschland hat diese Aufgabe nicht fristgerecht erfüllt. Praktisch heißt das: Es gibt derzeit keine offiziell benannte nationale Kontaktstelle, die Meldungen bündelt, Risiken priorisiert und Verfahren nach klaren Zuständigkeiten startet.

“Ohne klare Zuständigkeiten bleibt der AI Act graue Theorie – Regeln wirken erst, wenn sie verlässlich kontrolliert werden.”

Medienberichte und zivilgesellschaftliche Organisationen hatten die Bundesregierung bereits Anfang August zum schnellen Nachsteuern aufgefordert. Dazu zählen etwa Hinweise, dass fehlende Ansprechpartner Innovation ausbremsen können, weil Unternehmen unsicher werden, welche Prüfschritte nötig sind und wer Hilfestellung gibt. Für Betroffene erschwert die Lücke Beschwerden über riskante Systeme.

Tabellen sind nützlich, um Daten strukturiert darzustellen. Hier ist ein kompakter Überblick über zentrale Wegmarken und Rollen im Governance-Setup des AI Act:

| Merkmal | Beschreibung | Stichtag/Status |

|---|---|---|

| Frist Benennung | Nationale Aufsichts- und Notifizierungsbehörden benennen | 02.08.2025 (verpasst) |

| EU-Ebene | EU AI Office / Europäischer AI-Rat unterstützen Koordination | laufend |

| Nationale Aufgaben | Marktüberwachung, Beschwerdestellen, Sanktionen | offen |

Klar ist: Es drohen nicht sofort EU-Strafen speziell aus dem AI Act heraus. Aber politische und rechtliche Verfahren gegen säumige Staaten sind möglich. Wichtiger ist der Alltag: Ohne benannte Strukturen drohen Reibungsverluste bei Einführung sicherer KI, die wir uns als Tech-Standort nicht leisten sollten.

AI-Act-Pflichten: Termine, Rollen, Zuständigkeiten

Der AI Act ist seit 2024 in Kraft und entfaltet seine Wirkung stufenweise. Einige Verbote traten bereits Anfang 2025 in Kraft. Mit der August-Frist sollten die Mitgliedstaaten die Verwaltung aufstellen, die künftig Prüfungen koordiniert und Marktaufsicht betreibt. Dazu gehören eine „benennende Behörde“ für Konformitätsstellen (Notifizierungen) und eine Marktüberwachungsstelle, die Regelverstöße verfolgt. Die EU-Kommission begleitet das über das AI Office und den europäischen Kooperationsrat.

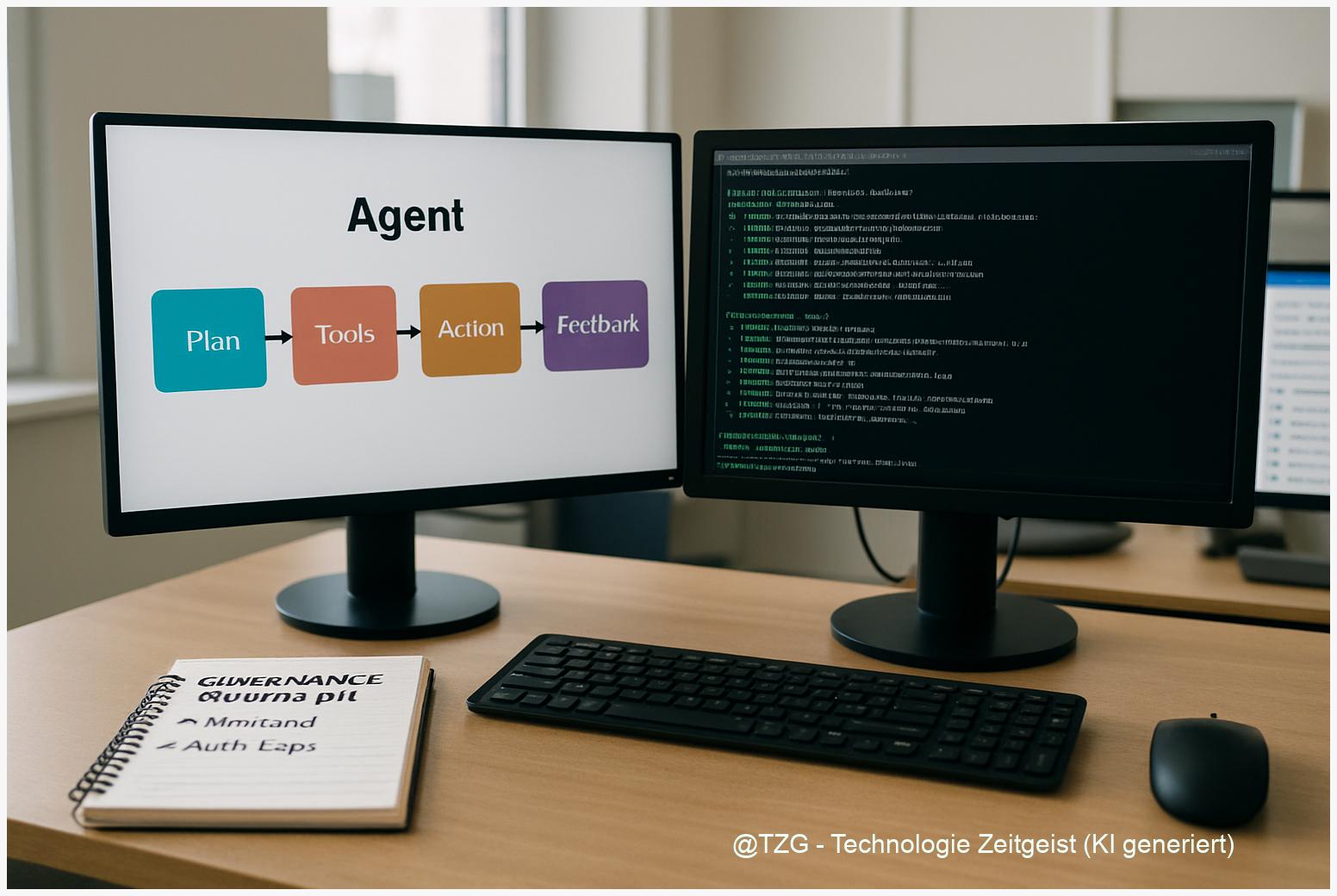

Deutschland ringt noch um die konkrete Architektur. Im Gespräch sind je nach Aufgabenprofil verschiedene Häuser und bestehende Behörden, etwa mit Blick auf digitale Infrastruktur, Sicherheit oder Verbraucherschutz. Denkbar ist ein Verbundmodell: Eine Leitstelle koordiniert, spezialisierte Fachbehörden prüfen. Dieses Modell passt zur föderalen Struktur – verlangt aber klare Schnittstellen, ein zentrales Portal und ausreichend Personal.

Für Unternehmen zählt der Pfad zur Praxistauglichkeit. Sie brauchen Kontaktstellen, Leitfäden und Fristen, die nicht im Wochenrhythmus wechseln. Für Bürger zählt, dass Beschwerden gehört werden und Entscheidungen erklärt sind. Für Forschung zählt, dass Sandboxes und Reallabore nicht an Formalien scheitern. Der AI Act gibt dafür das Gerüst. Was fehlt, ist die nationale Ausgestaltung – die nationale KI‑Aufsichtsbehörde ist das verbindende Element.

International schaut man genau hin. Deutschland hat Gewicht im EU-Binnenmarkt. Wenn hier Verfahren stocken, strahlt das aus. Umgekehrt kann ein gut organisiertes Modell Vertrauen schaffen: transparente Risikoprüfungen, klare Meldewege und eine pragmatische Begleitung für Start-ups. So wird Regulierung zum Standortvorteil statt zur Bremse.

Auswirkungen für Alltag und Wirtschaft

Die Lücke ist kein Randthema. Sie trifft ganz unterschiedliche Bereiche. Ein Mittelständler, der ein KI-Modul in seine Maschinen einbaut, fragt sich: Ist das Hochrisiko? Welche Dokumente braucht er? Ohne feste Ansprechpartner wird Compliance zur Hängepartie. Kommunen, die KI-gestützte Bürgerdienste planen, müssen klären, ob und wie Prüfungen laufen. Krankenhäuser, die Assistenzsysteme ausrollen wollen, brauchen Sicherheit, dass Zertifizierungen tragfähig sind.

Auch Verbraucherinnen und Verbraucher spüren die Unsicherheit. Meldungen zu problematischen Systemen – etwa fehlerhafte Profilings oder verzerrte Entscheidungsregeln – brauchen eine Adresse. Eine funktionierende Aufsicht sorgt nicht nur für Sanktionen, sondern auch für Beratung und Prävention. Sie erklärt Regeln in einfacher Sprache und hilft, Risiken früh zu erkennen. Das stärkt Vertrauen in KI im Alltag, vom Banking bis zur Mobilität.

Für die Tech-Szene ist Tempo entscheidend. Wer heute gründet, plant mit internationalem Roll-out. Unterschiedliche Ansprechpartner in den Mitgliedstaaten sind normal. Aber fehlende Ansprechpartner sind ein Wettbewerbsnachteil. Besonders heikel: Grenzüberschreitende Fälle. Ohne deutsche Kontaktstelle hängt vieles an der EU-Ebene fest, was Prozesse verlängert. Das kostet Zeit, Geld und am Ende auch Mut, in Europa zu skalieren.

Gute Nachrichten gibt es dennoch: Viel Know-how ist vorhanden, in Behörden, Verbänden und der Forschung. Wenn dieses Wissen gebündelt wird und die Meldewege klar sind, kann der Rückstand aufgeholt werden. Transparente Dashboards, schnelle FAQs und ein Service-Desk, der in Wochen statt Monaten steht – so wird aus einer verzögerten Ernennung ein Neustart mit Signalwirkung.

So holt Deutschland auf: Optionen und Zeitplan

Jetzt braucht es Entscheidungen, Ressourcen und Kommunikation. Kurzfristig sollte eine zentrale Kontaktstelle live gehen – mit Hotline, E‑Mail und einem einfachen Online-Formular. Parallel werden Zuständigkeiten festgelegt: Wer prüft Hochrisiko-KI? Wer betreut Sandboxes? Wer koordiniert Sanktionen? Ein öffentliches Organigramm schafft Klarheit. Wichtig ist auch ein Fahrplan, wann welche Services starten, damit Unternehmen planen können.

Mittelfristig zählt der Aufbau einer schlagkräftigen Organisation. Dazu gehören Teams für Marktaufsicht, Technik, Recht und Kommunikation. Nötig sind Budgets, Weiterbildungen und moderne IT. Eine nationale KI‑Aufsichtsbehörde kann als Netzwerk funktionieren: eine Leitstelle, die Daten bündelt, und Spezial-Einheiten, die tief in bestimmte Domänen einsteigen – von Gesundheit bis Industrie. Schnittstellen zur EU sichern, dass grenzüberschreitende Fälle sauber laufen.

Transparenz ist der Turbo. Ein monatlicher Lagebericht zeigt, welche Risiken auffallen, wo Leitfäden nachgeschärft werden und wie viele Meldungen eingehen. Für die Szene zählen auch positive Anreize: Schnellspuren für sichere Innovationen, Muster-Dokumente für Konformität, Sprechstunden für Start-ups. So entsteht Vertrauen – und aus Regeln wird Praxis. Und ja: Fehler passieren. Wichtig ist, sie offen zu benennen und Prozesse zu verbessern.

Zuletzt der Blick auf die Kommunikation. Menschen wollen wissen, was KI darf, was nicht, und an wen sie sich wenden. Klare Sprache, einfache Formulare und sichtbare Erfolge sind entscheidend. Wenn diese Elemente zusammenkommen, kann Deutschland die verpasste Frist schnell hinter sich lassen – und zeigen, dass Regulierung und Fortschritt zusammengehören.

Fazit

Deutschland hat die EU-Frist verpasst – doch das Zeitfenster, den Rückstand aufzuholen, ist noch offen. Entscheidend sind jetzt klare Zuständigkeiten, schnelle Kontaktwege und transparente Leitfäden. Mit einem schlanken Start und wachsender Tiefe kann die Aufsicht rasch Wirkung entfalten. Dann wird aus der Panne ein Projekt, das Sicherheit stärkt und Innovation möglich macht. Die Botschaft: Verlässliche Regeln zahlen sich aus.

Diskutiere mit: Wie sollte die deutsche KI-Aufsicht organisiert sein? Teile den Artikel in deinem Netzwerk und bring dich in den Kommentaren ein!

Schreibe einen Kommentar