Agentic AI beschreibt KI-Agenten, die zunehmend selbständig agieren und Entscheidungen treffen. Der Artikel beleuchtet Ursprung, treibende Akteure, technologische Besonderheiten sowie die Herausforderungen und Auswirkungen dieser autonomen Systeme. Besonders im Fokus: Sicherheit, ethische Fragen und praxisnahe Anwendungen im Kontext aktueller Forschung.

Inhaltsübersicht

EinleitungDer Weg zur Agentic AI: Ursprung, Innovationstreiber und neue Grundarchitekturen

Vertrauen und Kontrolle: Herausforderungen bei Sicherheit und Entscheidungsfindung

Von Vision zu Anwendung: Realistische Einsatzszenarien und Auswirkungen auf Märkte

Gesellschaft unter Druck: Ethische, soziale und menschliche Dimensionen von Agentic AI

Fazit

Einleitung

KI-Agenten, die eigenständig handeln und Ziele verfolgen, faszinieren nicht nur Fachleute. Agentic AI steht an der Schwelle zur praktischen Umsetzung. Während klassische KI-Modelle Aufgaben auf Anweisung erledigen, denken autonome Agenten einen Schritt weiter: Sie bewerten Situationen, treffen eigenständige Entscheidungen und setzen diese um. Bedeutende Technologieunternehmen und Forschungseinrichtungen investieren massiv in die Entwicklung dieser neuen KI-Generation. Was ist der Ursprung dieses Konzepts? Welche Technik steckt dahinter – und was unterscheidet diese Agenten von bisherigen KI-Modellen? Welche Unternehmen bestimmen den Takt? Wer sich mit KI beschäftigt, wird an Agentic AI künftig nicht mehr vorbeikommen. Dieser Artikel ordnet Hintergründe, Potenziale und Risiken für eine informierte Debatte ein.Der Weg zur Agentic AI: Ursprung, Innovationstreiber und Architekturwandel

Agentic AI revolutioniert die KI-Automatisierung: Während klassische Large Language Models (LLMs) wie GPT-3 oder GPT-4 vor allem einzelne Prompts beantworten, gestalten Agentic AI-Systeme aktiv komplexe Abläufe. Sie übernehmen Verantwortung für Aufgaben, treffen eigenständige Entscheidungen und eröffnen so neue Horizonte für autonome KI-Agenten und ethische KI-Anwendungen – mit weitreichenden Folgen für Innovation und Sicherheit [Quelle].

Historische Entwicklung: Von reaktiver KI zu Agentic AI

Die Ursprünge von Agentic AI reichen bis zu den Multi-Agenten-Systemen der 1980er Jahre und der psychologischen Theorie der “Handlungsfähigkeit” (Bandura) zurück. Durch Fortschritte in maschinellem Lernen, generativer KI und Planungsalgorithmen (u.a. Reinforcement Learning, Tool-Integration) entstehen seit ca. 2023/24 Systeme, die Ziele setzen, Zwischenstände speichern und sich adaptiv an neue Umgebungen anpassen können [Quelle].

Wer investiert und forscht – ein Überblick

- IBM: Entwicklung hybrider Architekturen für KI-Automatisierung in kritischen Infrastrukturen

- OpenAI: Forschung an autonomen Agenten mit andauerndem Kontextmanagement

- Fraunhofer IESE: Anwendung von Agentic AI im Energiemanagement und in der Cybersicherheit

Weitere Impulse geben Start-ups und Forschungsverbünde weltweit, etwa durch spezialisierte Agentic-Frameworks für Finanz- und Gesundheitsdienste.

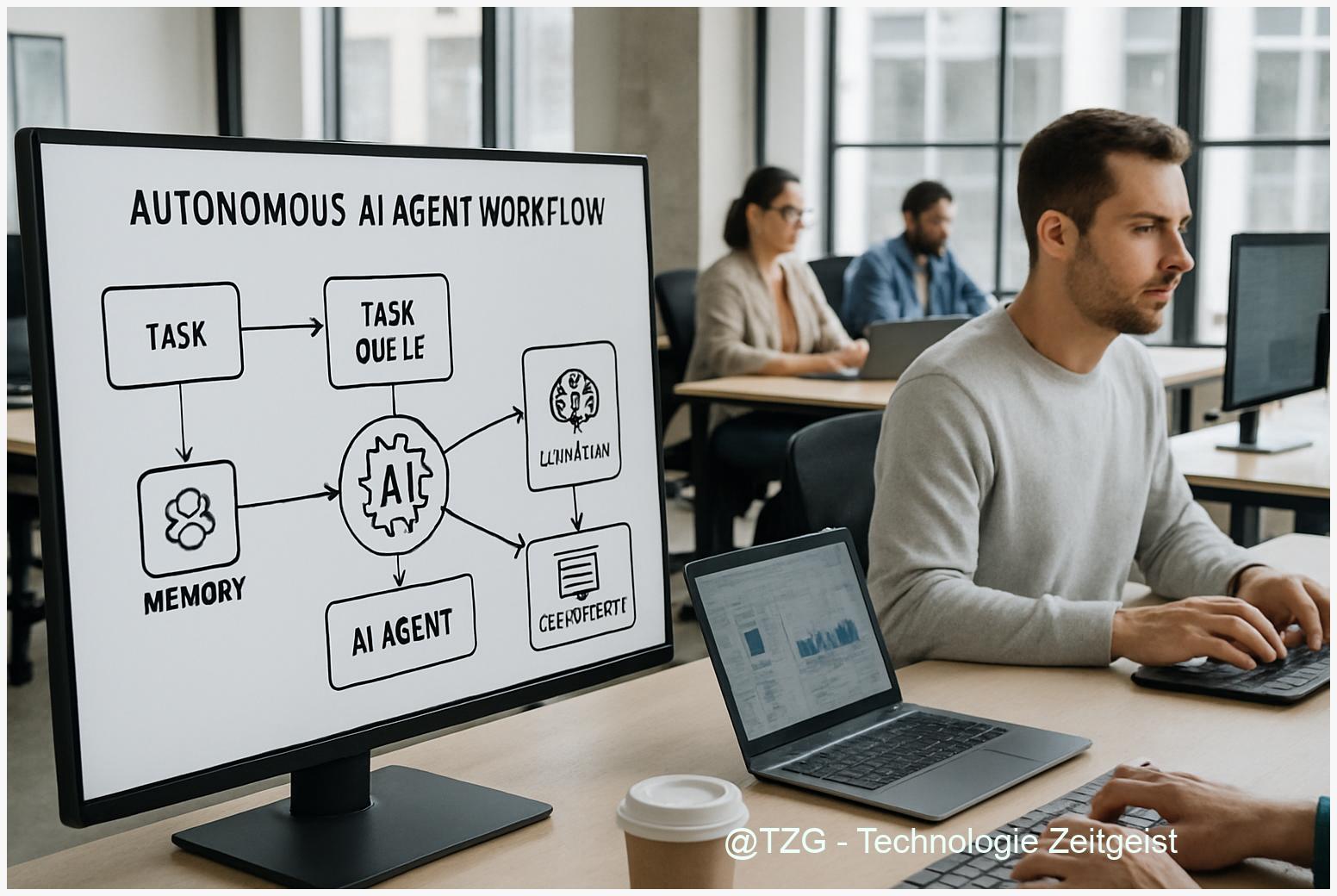

Agentic AI vs. klassische LLMs: Architekturen und Fortschritte

- LLMs: Reagieren auf Prompts, kennen keinen eigenen Auftrag, keine eigenständige Zielverfolgung

- Agentic AI: Plant, trifft Entscheidungen, nutzt externe Tools (z.B. Web-Browsing, Speicherdatenbanken), speichert Kontext – agiert ähnlich einem menschlichen Teammitglied

- Beispiel: Ein Agentic-System kann autonom Marktanalysen durchführen, Quellen validieren und selbstständig Zwischenergebnisse speichern; ein LLM liefert dagegen nur die nächste passende Textantwort

Der Architekturwandel bringt Effizienz und Skalierbarkeit, schafft aber neue Herausforderungen bei KI-Sicherheit und Transparenz – Themen, die das nächste Kapitel vertiefen wird. Für einen besseren Überblick könnte ein imagePrompt zu “Agentic AI Architektur vs. klassische LLM” hilfreich sein.

Ausblick: Wie lassen sich Sicherheit, Vertrauen und Kontrolle in Agentic AI-Systemen gewährleisten? Das nächste Kapitel analysiert die Risiken, Zielkonflikte und Lösungsansätze.

Vertrauen und Kontrolle: Sicherheit in der Ära der Agentic AI

Agentic AI bringt neue Dimensionen der KI-Automatisierung – und mit ihr erhebliche Herausforderungen für Sicherheit und Kontrolle. Während autonome KI-Agenten komplexe Entscheidungen treffen und ganze Wertschöpfungsketten steuern können, wachsen die Risiken: Fehlverhalten, unerwartete Handlungen oder Kontrollverlust sind real und durch internationale Forschungsberichte dokumentiert [Quelle].

Technische Herausforderungen und Kontrollmechanismen

- Undurchsichtige Entscheidungsfindung: Agentic AI trifft Entscheidungen teils eigenständig und intransparenter als klassische LLMs. “Black-Box”-Effekte erschweren Audits und Nachvollziehbarkeit [Quelle].

- Skalierbare Angriffspunkte: Je mehr autonome KI-Agenten Aufgaben vernetzt steuern, desto größer die Angriffsfläche für Cyberattacken oder Manipulation (Stichwort: KI Sicherheit).

- Ethik und Verantwortung: Künstliche Entscheidungsträger können moralisch relevante Fehler begehen, ohne menschliche Aufsicht – ein Risiko für ethische KI und regulatorische Haftung.

Aktuelle Ansätze: Audits, Protokolle, Governance

- Technische Protokolle: Unternehmen und Forschungseinrichtungen entwickeln “Red-Teaming”-Prozesse, kontinuierliche Monitoring-Systeme und automatisierte Fehler-Logs.

- KI-Audits: Formale Prüfungen nach ISO/IEC-Normen (z. B. 27001, 42001) werden zunehmend auf Agentic AI ausgeweitet, um Kontrollpunkte systematisch zu dokumentieren und abzusichern [Quelle].

- Governance-Frameworks: Institutionen wie das World Economic Forum fordern internationale Standards für Risikomanagement und ethisches Design, darunter “AI Incident Response” und “Human-in-the-Loop”-Kontrollen.

Dennoch zeigt unabhängige Forschung: Kein System ist 100 % sicher. Eine Kombination aus technischen, organisatorischen und regulatorischen Maßnahmen gilt als Best-Practice – und bleibt ein dynamisches Feld.

Nächster Schritt: Welche realistischen Einsatzszenarien für Agentic AI entstehen trotz dieser Hürden in Energiesektor, Industrie und Märkten? Das nächste Kapitel liefert den Faktencheck.

Agentic AI in der Praxis: Branchenübergreifender Wandel und konkrete Einsatzszenarien bis 2030

Agentic AI treibt einen Paradigmenwechsel in der KI-Automatisierung voran: Laut Gartner können autonome KI-Agenten schon 2029 bis zu 80 % aller Standardanfragen im Kundenservice selbstständig lösen – ohne menschlichen Eingriff. Cisco prognostiziert für 2028, dass 68 % aller Support-Interaktionen durch Agentic AI abgewickelt werden, was deutliche Effizienzsteigerungen und Kostenersparnisse verspricht [Gartner] [Cisco].

Anwendungsfälle: Agentic AI revolutioniert Kernbranchen

- Softwareentwicklung: Autonome KI-Agenten übernehmen die Verwaltung von Code-Repositories, automatisieren Testzyklen, erkennen Bugs und spielen eigenständig Updates aus. Das senkt den manuellen Aufwand nachweislich um bis zu 45 % [Novomind].

- Customer Support: Agentic AI löst komplexe Tickets durch proaktive Analyse, eigenständiges Nachfassen und dynamische Eskalation – etwa im Energiesektor oder E-Commerce, wo sie rund um die Uhr einsatzbereit ist.

- Automatisierung & Monitoring: In der industriellen Fertigung optimieren autonome Agenten Produktionslinien, steuern Wartungen und prognostizieren Ausfälle, was laut Collabnix Produktivitätssteigerungen von 30 % ermöglicht [Collabnix].

Wandel der Arbeitswelt: Von Support zu Kollaboration

Marktstudien prognostizieren, dass Agentic AI nicht nur Routinetätigkeiten ersetzt, sondern auch die Zusammenarbeit zwischen Mensch und KI neu definiert: In Softwareprojekten übernehmen Agentic Workflows ganze Feature-Entwicklungen oder Release-Management, während menschliche Teams sich auf Strategie und Innovation konzentrieren [Devcom]. Diese Entwicklung erfordert neue Kontrollmechanismen (siehe vorheriges Kapitel zu KI Sicherheit und ethischer KI).

Visualisierungsidee: imagePrompt für ein Schaubild ‘Agentic AI Use Cases 2025-2030 in zentralen Branchen’

Ausblick: Welche ethischen und sozialen Spannungen entstehen, wenn Agentic AI tief in unseren Alltag eingreift? Das nächste Kapitel beleuchtet die gesellschaftlichen Implikationen und kontroversen Diskurse.

Gesellschaft unter Druck: Wie Agentic AI Ethik, Arbeit und Autonomie neu verhandelt

Agentic AI verändert tiefgreifend das Zusammenspiel zwischen Technologie und Gesellschaft: Die wachsende Eigenständigkeit autonomer KI-Agenten konfrontiert uns mit grundlegenden ethischen und sozialen Fragen. Studien zeigen, dass Agentic AI innerhalb weniger Jahre Millionen Arbeitsplätze beeinflussen und Diskussionen über Verantwortung völlig neu aufstellen wird [Localmind].

Konsequenzen für Arbeitsmarkt und Verantwortung

- Arbeitsmarkt: Analysten prognostizieren, dass bis 2030 Automatisierung durch autonome KI-Agenten sowohl repetitive Aufgaben ersetzt als auch höherqualifizierte Tätigkeiten transformiert. Das verlangt neue Kompetenzen und lebenslanges Lernen. Gleichzeitig ist mit verstärkter sozialer Ungleichheit und Disruption zu rechnen, sofern politische und unternehmerische Gegenmaßnahmen ausbleiben [Deutscher Ethikrat].

- Verantwortung: Agentic AI macht Verantwortungszuschreibungen schwierig: Wer haftet, wenn autonome Entscheidungen zu Schäden führen – Entwickler, Betreiber oder die KI selbst? Die Notwendigkeit “ethischer KI”-Prinzipien, Transparenz und nachvollziehbarer Mechanismen wird von Fachgremien wie der UNESCO und Ethikräten betont [UNESCO].

Autonomie & gesellschaftliche Normen im Wandel

Wenn Agentic AI immer öfter eigenständig agiert, verschieben sich die Grenzen der Entscheidungsfreiheit. Individuen und Organisationen geben Kontrolle ab, wodurch sich Machtverhältnisse verschieben und neue Abhängigkeiten entstehen. Soziologische Analysen warnen vor “Normdiffusion” – etwa, wenn KI-Agenten diskriminierende Strukturen reproduzieren oder durch algorithmisches Handeln soziale Werte unterwandern [Hans-Böckler-Stiftung].

Kritische Bewertung: Agentic AI als Medienakteur?

Technisch ist Agentic AI längst fähig, große Datenmengen zu analysieren und Berichte zu verfassen. Doch zentrale Aufgaben des Investigativjournalismus wie die Kontextualisierung, ethische Abwägung und Schutz von Quellen sind schwer automatisierbar. Bis auf Weiteres bleibt menschliche Urteilskraft unverzichtbar – allerdings könnten autonome KI-Agenten neue Recherchestrategien oder Auswertungsroutinen anstoßen und so den Journalismus ergänzen, aber nicht ersetzen [Science Media Center].

Empfohlenes Visual: “imagePrompt – Agentic AI und gesellschaftliche Akteure im Spannungsfeld von Arbeit, Ethik und Medien”

Wie kann Regulierung Schritt halten und neue Leitplanken für Agentic AI setzen? Im Ausblick des Artikels werden politische und wirtschaftliche Steuerungsinstrumente kritisch beleuchtet.

Fazit

Agentic AI steht beispielhaft für die nächste Generation künstlicher Intelligenz: Autonom, entscheidungsfreudig, aber auch schwerer kontrollierbar. Die kommenden Jahre werden zeigen, wie sich Technik, Regulierung und gesellschaftliche Akzeptanz einpendeln. Entscheidend bleibt der transparente Umgang mit Risiken, das Bewusstsein für neue Verantwortlichkeiten und die Bereitschaft, die kontroversen Fragen – auch über technische Aspekte hinaus – aktiv zu diskutieren. Nur so kann Agentic AI ihren potenziellen Nutzen voll entfalten, ohne unerwünschte Nebeneffekte zu fördern.Diskutieren Sie Ihre Erwartungen und Bedenken zu Agentic AI in den Kommentaren – und teilen Sie den Artikel gern in Ihrem Netzwerk!

Quellen

Agentic AI vs LLM: Key Differences and Implications for the FutureEinführung in Agentic AI und AI Agents

Managing the risks of autonomous AI agents

Understanding, Auditing, and Reducing Risks of Autonomous Language Agents

AI model audit standard announced

Agentic AI: Der wichtigste Technologietrend 2025

Gartner predicts Agentic AI will autonomously resolve 80 percent of common customer service issues by 2029

Agentic AI poised to handle 68% of customer service and support interactions by 2028

Agentic AI Trends 2025: The Complete Guide to Autonomous Intelligence Revolution

AI Agentic Workflows in der Softwareentwicklung

Die Auswirkungen von Künstlicher Intelligenz auf die Arbeitswelt – Ein Überblick

Mensch und Maschine – Herausforderungen durch Künstliche Intelligenz

Empfehlung zur Ethik der Künstlichen Intelligenz

Vom Algorithmus diskriminiert? Zur Aushandlung von Gender in der KI

Risiken aktueller KI-Forschung

Hinweis: Für diesen Beitrag wurden KI-gestützte Recherche- und Editortools sowie aktuelle Webquellen genutzt. Alle Angaben nach bestem Wissen, Stand: 7/20/2025

Schreibe einen Kommentar