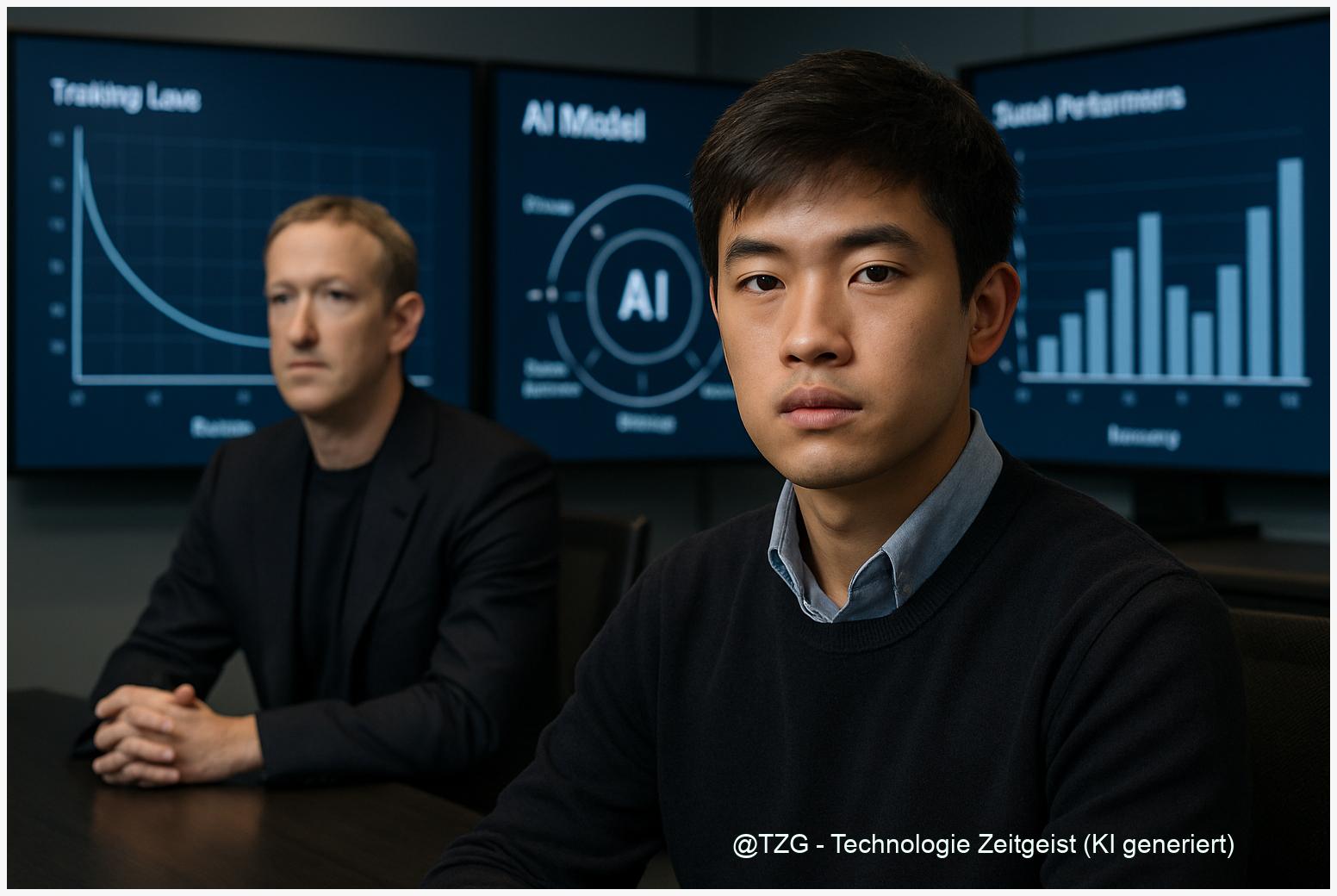

Meta stellt Führung neu auf: Was Alexandr Wangs Rolle für KI-Innovation bedeutet

So., 02 Feb 2025 – Warum nimmt Meta jetzt eine Führungsänderung bei seiner KI-Sparte vor? Alexandr Wangs Aufstieg verschiebt Kompetenzen, Budgets und Forschungsziele. Direkt beantwortet: Meta setzt stärker auf angewandte Modelle und beschleunigte Produktintegration, während Grundlagenforschung unter Druck geraten könnte. Dieser Artikel analysiert Strukturen, Konflikte und die Folgen für Nutzer, Wissenschaft und Märkte.

Inhaltsübersicht

Einleitung

Neue Strukturen bei Meta AI

Machtfragen, Entscheidungsstrukturen und Forschungsagenda

Konflikte zwischen Offenheit, Geschäft und Regulierung

Ausblick, Gegenstimmen und mögliche Fehlprognosen

Fazit

Einleitung

Meta AI steht vor einer entscheidenden Zäsur. Alexandr Wang, bislang als Gründer von Scale AI bekannt, erhält bei Meta mehr Verantwortung und damit Einfluss auf die strategische Ausrichtung der KI-Programme. Die Umstrukturierung ist kein formaler Akt im Hintergrund, sondern eine bewusst gesetzte Weichenstellung mit Folgen für Forschung, Produktentwicklung und globale Wettbewerbsposten. Während FAIR bislang als Symbol für offene Wissenschaft galt, wächst der Druck, kommerzielle Ergebnisse schneller vorzuweisen. In diesem Artikel beleuchten wir konkrete Änderungen an Titeln, Budgetlinien und Entscheidungswegen, untersuchen Wangs Einfluss auf technische Prioritäten und analysieren Interessenkonflikte zwischen Grundlagenforschung, Geschäftsstrategie und Regulierung. Schließlich werden wir die möglichen Folgen für Nutzer, Forschende und Umwelt einordnen – und prüfen, an welchen Indikatoren der Erfolg oder Misserfolg dieser Neuausrichtung in Zukunft erkennbar sein wird.

Neue Strukturen bei Meta AI

Meta AI hat im Juni 2024 eine der umfassendsten Umstrukturierungen seiner Geschichte vollzogen (Stand: 27. August 2024). Mit dem Führungswechsel durch Alexandr Wang als Chief AI Officer wurde das bisherige Superintelligence Labs in vier neue Einheiten aufgeteilt: TBD Lab, FAIR Forschung, Products & Applied Research sowie MSL Infra. Wang berichtet direkt an Mark Zuckerberg. Diese Neuausrichtung soll die Umsetzung kommender KI-Innovationen beschleunigen und gezielt Ressourcen für Product-Launches wie Llama 4 und den Meta AI Assistant steuern Business Insider

.

Zu den markanten Änderungen zählen neue Berichtslinien: Rob Fergus bleibt Leiter der FAIR Forschung und berichtet jetzt direkt an Wang, während Yann LeCun als Chief Scientist von FAIR ebenfalls an Wang angebunden ist. Die Leitung für Produktentwicklung übernimmt Nat Friedman (ehemals GitHub-CEO), die Infrastruktur verantwortet Aparna Ramani. Mit der Neustrukturierung verschiebt Meta AI einen erheblichen Teil des Forschungs- und Entwicklungsbudgets in Richtung Infrastruktur und Model-Training: Das AI-Kapitalbudget liegt für 2024/2025 bei 66–72 Mrd. USD, dazu kommt eine Investition von 14,3 Mrd. USD in Scale AI, um Datenzuverlässigkeit und Modelltraining zu sichern Reuters

.

Die Unterscheidung zwischen Grundlagenforschung (FAIR) und angewandter Entwicklung (Products) wird formal deutlicher: FAIR bleibt mit etwa 1 000 Mitarbeitenden stabil, verteilt auf internationale Standorte. Applied und Product Teams wachsen durch gezielten Ressourcenzufluss. Der aktuelle Fahrplan: Llama 4 ist seit Sommer 2024 im Roll-out, der Meta AI Assistant wird in den Plattformen integriert, während das TBD Lab an einem experimentellen, multimodalen Omni-Modell arbeitet Fortune

. Analysten sehen Meta AI damit gut gerüstet, die wachsenden Anforderungen der generativen KI zu bedienen, warnen aber vor Talentabwanderung durch wiederholte Umstrukturierungen TechTarget

.

Damit ist die Bühne bereitet für neue Fragen zu Machtverteilung, Entscheidungswegen und Forschungsagenda. Im nächsten Kapitel: Machtfragen, Entscheidungsstrukturen und Forschungsagenda.

Machtfragen, Entscheidungsstrukturen und Forschungsagenda

Meta AI steht nach dem Führungswechsel zu Alexandr Wang (Stand: August 2025) vor einer Neuordnung der Machtverhältnisse und Entscheidungswege. Wang leitet als Chief AI Officer das neue Superintelligence Lab und bündelt damit die Verantwortung für Forschung, Produktentwicklung, Infrastruktur und experimentelle Teams. Produkt- und Forschungsleitungen, etwa Rob Fergus (FAIR Forschung) und Nat Friedman (Products & Applied Research), berichten direkt an Wang und sind mit klaren Entscheidungsbefugnissen ausgestattet. Die finale Freigabe für Modell-Launches, Open-Source-Releases und Risiko-Stops liegt nun gebündelt bei Wang, mit direkter Eskalationslinie zu Mark Zuckerberg und dem Board. Yann LeCun hält als Chief Scientist von FAIR ein Vetorecht bei der Nutzung proprietärer Benchmarks und bleibt Vordenker für Open-Science und offene ModelleBusiness Insider

.

Entscheidungsstrukturen und Eskalationspfade

Die Entscheidungswege bei Meta AI sind präzise geregelt: Ein internes Benchmark Council evaluiert gemeinsam mit Produkt- und Forschungsteams den Reifegrad neuer Modelle, bevor sie in die Produkte (wie Llama 3.1 oder Meta AI Assistant) integriert werden. Im Falle kritischer Risiken – etwa bei Sicherheitslücken oder ethischen Bedenken – kann der Council einen Stopp empfehlen. Die Entscheidung über ein „Go“ oder „No-Go“ trifft aber letztlich Wang. LeCun bringt mit seinem Open-Source-Fokus und seiner Beteiligung an LiveBench und MMLU weiterhin das Gegengewicht zum Produktdruck einFortune

.

Technische Prioritäten und Methoden

Wang setzt in der Forschungsagenda von Meta AI auf großdimensionierte, multimodale Modelle und den Ausbau von RLHF-Methoden (Reinforcement Learning from Human Feedback). Das neue Constrained Generative Policy Optimization (CGPO) – vorgestellt in einer aktuellen arXiv-Publikation – wird als Benchmark für Robustheit, Reduktion von Reward Hacking und Senkung von Hallucination Rates genutzt. Die Products & Applied Research-Teams evaluieren Modelle auf offenen Standards wie LiveBench, MMLU sowie internen Maverick-Benchmarks. Die Effektivität von RLHF und CGPO zeigt sich etwa in einer um 7,4 % verbesserten Leistung auf AlpacaEval-2 gegenüber PPOarXiv

. Gleichzeitig bleibt LeCuns Open-Science-Ethos präsent: Offene Benchmarks und JEPA-Architekturen bilden einen methodischen Gegenpol zur schnellen ProduktoptimierungLex Fridman Podcast

.

Die Balance zwischen Produktdruck und Forschung bleibt damit ein ständiges Ringen, das Governance-Boards, unabhängige Audits und eine transparente Metrik-Strategie zum festen Bestandteil macht. Im nächsten Kapitel: Konflikte zwischen Offenheit, Geschäft und Regulierung.

Konflikte zwischen Offenheit, Geschäft und Regulierung

Meta AI ringt im Spannungsfeld zwischen ökonomischen Zielen, regulatorischen Vorgaben und der offenen Forschungstradition von FAIR Forschung (Stand: August 2025). Während Meta mit KI-Innovationen neue Werbeformate und Unternehmensdienste erschließt, verlangen Regulierungen wie der EU-AI-Act eine genaue Offenlegung von Trainingsdaten und Lizenzmodellen. Das Unternehmen hat die Veröffentlichung eines fortgeschrittenen, multimodalen Llama-Modells in Europa aufgrund regulatorischer Unsicherheiten ausgesetzt. Diese Zurückhaltung steht im Kontrast zu FAIRs Open-Science-Ethos, der Transparenz und freie Zugänglichkeit fordert The Guardian

.

Ökonomische Zielkonflikte und Karrieredynamik

Meta AI investiert massiv in KI-Talente – teils mit Bonuspaketen bis zu 300 Mio. USD. Das Ziel: KI-Innovation für Werbeprodukte und Cloud-Dienste. Von Wangs Aufstieg profitieren vorrangig Führungskräfte und Investoren, aber auch ehemalige Start-up-Partner, mit denen IP-Lizenzen und Daten-Sharing-Vereinbarungen bestehen. Es drohen Interessenkonflikte, etwa durch frühere Kontakte zu Scale AI oder die Nutzung von urheberrechtlich geschützten Trainingsdaten, was aktuell Gegenstand von Klagen ist Wired

.

Folgen für Nutzer, Forschungslandschaft und Umwelt

Für Nutzer und Forschende bringt der Führungswechsel geteilte Effekte: Einerseits profitieren sie von offenen Modellen wie Llama 3.2, andererseits erschweren restriktive Lizenzen und selektive Veröffentlichungen den Zugang. Die aggressive Talentakquise Meta AIs führt zu einer Konzentration von KI-Expertise – 2024 wechselten laut Forbes 4,3 % der neuen KI-Lab-Mitarbeitenden innerhalb der Branche zu Meta; der Talent-Wettbewerb schwächt kleinere Forschungsstandorte Forbes

. Die Umweltauswirkungen sind erheblich: Meta meldet seit 2020 Netto-Null-Emissionen in den eigenen Betrieben und deckt 100 % des Stroms aus erneuerbaren Energien. Dennoch bleibt der erhöhte Strombedarf für KI-Training kritisch. Der jüngste Nachhaltigkeitsbericht nennt für 2024 über 11 700 MW erneuerbare Energieverträge, aber keine Modell-spezifischen CO₂-Zahlen Meta Sustainability Report

.

Wenn Du wissen willst, wie Kritiker und unabhängige Forscher diese Balance bewerten und welche Fehlprognosen Meta drohen, lies das nächste Kapitel: Ausblick, Gegenstimmen und mögliche Fehlprognosen.

Ausblick, Gegenstimmen und mögliche Fehlprognosen

Meta AI steht nach dem Führungswechsel zu Alexandr Wang und dem stärkeren Produktfokus im Kreuzfeuer kritischer Stimmen (Stand: August 2025). Yann LeCun und Mitglieder der FAIR Forschung warnen davor, dass ein zu starker Fokus auf schnelle KI-Innovation und Monetarisierung die Grundlagenforschung marginalisiert und die wissenschaftliche Glaubwürdigkeit gefährdet. Empirische Belege liefern Publikationszahlen: Die Zahl der FAIR-Publikationen sank 2024 um rund 5 % gegenüber 2023 (von etwa 1 200 auf 1 140), der Impact bleibt mit durchschnittlich 12 Zitaten pro Veröffentlichung aber hoch. Reproduzierbarkeitsstudien und unabhängige Sicherheitsprüfungen fordern mehr Transparenz und Governance, insbesondere bei generativen Modellen wie Chatbots. Kritisiert werden spezifische Policy-Lücken und dokumentierte Sicherheitsvorfälle Reuters

, TechPolicy Press

.

Plausible Roadmaps: Integration, Open Source, Grundlagenwissenschaft

Für die kommenden 12–36 Monate erwarten Analysten eine beschleunigte Integration großer KI-Modelle in Meta-Produkte, eine gezieltere Monetarisierung im Werbe- und Unternehmenskundengeschäft sowie selektive Open-Source-Initiativen. Die Grundlagenforschung bleibt erhalten, erhält aber voraussichtlich weniger Budget (Anteil sinkt von 15 % auf 10 % am KI-Budget). Im 5-Jahres-Ausblick bestimmen Schlüsselressourcen wie GPU/TPU-Kapazitäten, verfügbare KI-Talente, IP-Lizenzen und regulatorische Hürden, wie schnell Meta AI neue Innovationen umsetzen kann. Verzögerte Meilensteine und überambitionierte Superintelligence-Roadmaps der letzten Jahre mahnen zur Vorsicht NYTimes

, Fortune

.

Erfolg oder Irrtum? Messbare Signale für die Beurteilung

Ob der Kurswechsel erfolgreich war, wird sich an konkreten Kennzahlen zeigen: Dazu zählen Publikationen und Patente pro Jahr, der Anteil Open-Source-Beiträge, Fluktuation von Spitzenforschenden sowie regulatorische Sanktionen und wirtschaftliche Resultate aus KI-Produkten. Den größten Unterschied machen dabei nachhaltige Talentrekrutierung und robuste Sicherheits-Governance. Alternativen für Meta hätten in einer klareren Trennung von Produkt- und Forschungsstrukturen oder unabhängigen Audits gelegen. Das bleibt die Benchmark für die Bewertung der KI-Innovation unter neuer Führung AP

.

Fazit

Die Ernennung und Stärkung von Alexandr Wang markiert eine Weichenstellung zwischen Forschungsidealen und unternehmerischen Notwendigkeiten. Durch die Umstrukturierung könnte Meta seine Fähigkeit beschleunigen, Marktanteile im KI-Sektor zu gewinnen – mit potenziellen Kosten für offene Wissenschaft und Energieeffizienz. Gleichzeitig wird sich zeigen, ob die internen Spannungen zwischen FAIR und produktorientierten Abteilungen handhabbar bleiben. Für Nutzer und Forschende steht viel auf dem Spiel: Zugang zu frei verfügbaren Modellen, Karrierechancen und verantwortungsvolle Umweltpolitik. Die kommenden fünf Jahre liefern messbare Antworten; entscheidend werden die Innovationsdynamik, regulatorische Entwicklungen und Meta’s Umgang mit Transparenz und Sicherheit sein. Wangs Rolle wird sich daran messen müssen, ob er mehr Momentum oder mehr Reibung erzeugt hat.

Diskutiere mit: Wird Metas Fokuswechsel unter Alexandr Wang Innovation beschleunigen oder die offene Forschung bremsen? Teile deine Einschätzung!

Quellen

Read the Full Memo Alexandr Wang Sent About Meta’s Massive AI Reorg

Meta plans fourth restructuring of AI efforts in six months

Meta’s AI research lab is ‘dying a slow death,’ some insiders say—but Yann LeCun pushes back

Meta restructures AI division aiming for superintelligence

Read the Full Memo Alexandr Wang Sent About Meta’s Massive AI Reorg

Alexandr Wang is now leading Meta’s AI dream team. Will Mark Zuckerberg’s big bet pay off?

The Perfect Blend: Redefining RLHF with Mixture of Judges (CGPO)

Transcript for Yann LeCun: Meta AI, Open Source, Limits of LLMs, AGI & the Future of AI

Meta to withhold release of advanced AI multimodal Llama model in EU

New Documents Reveal Meta Used Pirated Data to Train AIs

Zuckerberg Squandered His AI Talent. Now He’s Spending Billions to Replace It

Meta 2024 Sustainability Report

Meta’s head of AI research to depart in May

Experts React to Reuters Reports on Meta’s AI Chatbot Policies

Zuckerberg Again Overhauls Meta’s A.I. Efforts

Meta’s FAIR papers, roadmap and the future of open innovation

Meta’s head of AI research stepping down

Hinweis: Für diesen Beitrag wurden KI-gestützte Recherche- und Editortools sowie aktuelle Webquellen genutzt. Alle Angaben nach bestem Wissen, Stand: 8/20/2025