Blackwell Ultra: Wie Nvidia und Dell die Grenzen von KI-Servern neu definieren

Nvidia und Dell setzen mit den neuen Blackwell Ultra-GPUs und PowerEdge-Servern den neuen Standard für KI-Infrastrukturen. Bis zu 256 GPUs pro Rack, vierfache Trainingsgeschwindigkeit und innovative Kühltechnologien eröffnen neue Möglichkeiten – und werfen wichtige Fragen zu Energie, Sicherheit und Marktumbruch auf.

Inhaltsübersicht

Einleitung

Technologische Sprungkraft: Was Blackwell Ultra-GPUs und PowerEdge-Server einzigartig macht

Alle Augen auf Dell und Nvidia: Die Hauptakteure und ihr Wettlauf um KI-Infrastruktur

Warum Unternehmen jetzt umdenken: Auswirkungen auf Märkte, Energie und Sicherheit

Vermittlung und Reaktion: Wie Dell und Nvidia ihre Innovationen positionieren

Fazit

Einleitung

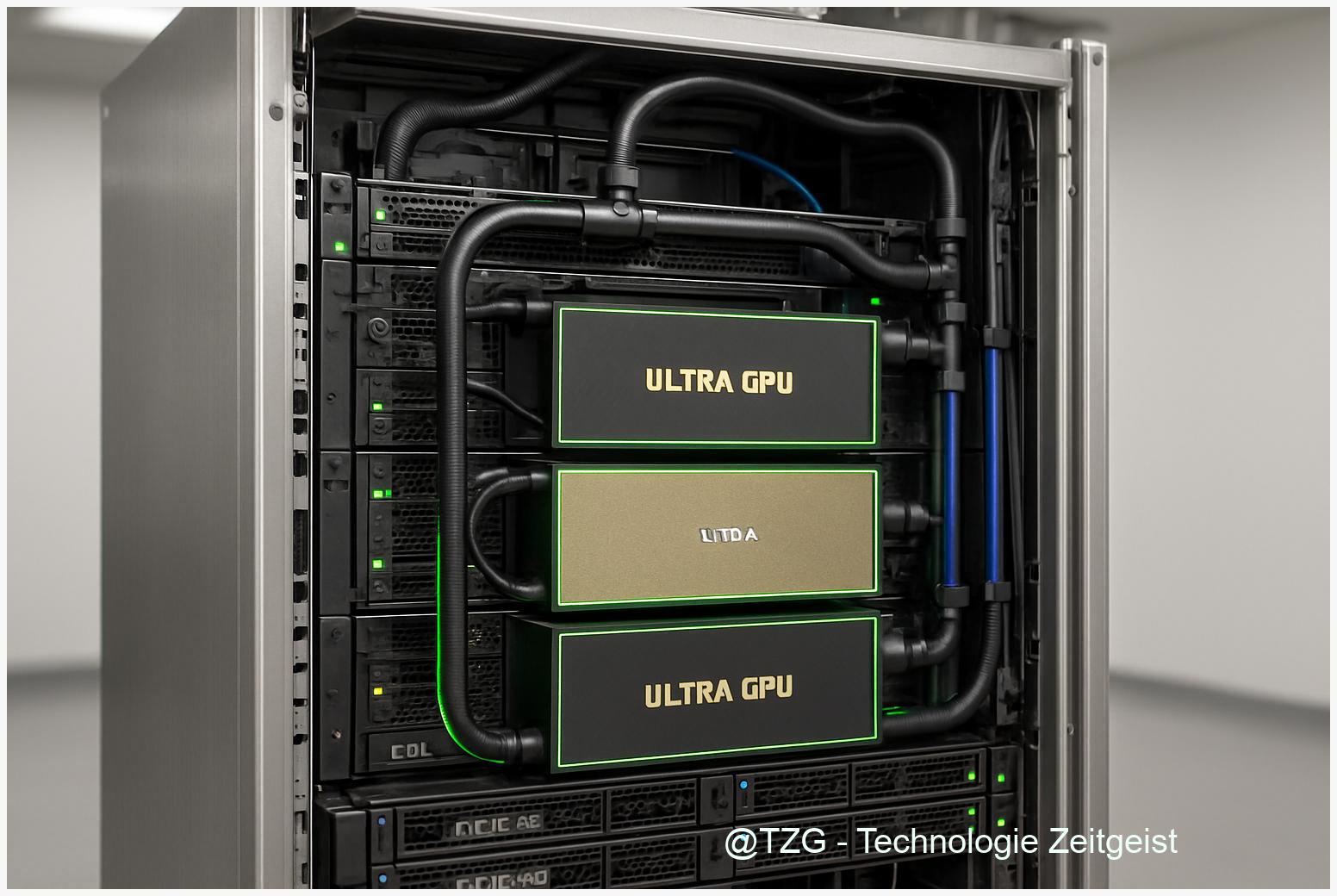

Die Entwicklung von KI-Modellen verlangt immer leistungsfähigere Rechenzentren. Mit der gemeinsamen Vorstellung der Blackwell Ultra-GPUs von Nvidia und Dells neuer Generation von KI-Servern läuten zwei Tech-Giganten einen Paradigmenwechsel ein. Plötzlich ist die Skalierung auf hunderte spezialisierte KI-Beschleuniger in einem einzigen Rack möglich – und das Ganze effizienter und sicherer als je zuvor. Doch was steckt technisch dahinter, wie gelingt diese Dichte, wer profitiert davon und welche Auswirkungen hat der Startschuss eines neuen Wettrüstens im KI-Markt? Ein Blick auf die Fakten, die Technologien und die Folgen für Wirtschaft, Umwelt und Innovation.

Technologische Sprungkraft: Was Blackwell Ultra-GPUs und PowerEdge-Server einzigartig macht

208 Milliarden Transistoren – das Herzstück der Revolution

Nvidia Blackwell Ultra markiert eine technologische Zäsur im KI-Rechenzentrum. Jede GPU vereint eindrucksvolle 208 Milliarden Transistoren – gefertigt im präzisen 4NP-Verfahren von TSMC, was extrem feine Strukturen und gesteigerte Energieeffizienz erlaubt. Zentrale Neuerung: Die zweite Generation der Transformer-Engine hält Einzug, samt der weiterentwickelten Tensor-Kerne, die jetzt auch mit der ultra-kompakten FP4-Präzision umgehen können. Das bringt enorme Geschwindigkeitsvorteile beim Training großer KI-Modelle.

Interne Verbindung, externe Wirkung

GPU-Skalierung funktioniert, weil die Blackwell Ultra-GPUs untereinander per Chip-zu-Chip-Verbindung mit bis zu 10 Terabyte pro Sekunde kommunizieren. Das Resultat: Bis zu 256 dieser Chips lassen sich in einem einzigen Server-Rack zusammenschalten, koordiniert von Dells neuen PowerEdge XE9680L und XE8712-Systemen. Es entsteht eine skalierbare KI-Infrastruktur, die für Aufgaben wie Sprachmodelle oder Bildgenerierung unverzichtbar wird.

Kühltechnologien treffen Sicherheit

Dell begegnet der massiven Wärmeentwicklung mit Direct Liquid Cooling. Hier fließen Kühlflüssigkeiten direkt an die heißen Komponenten heran – klassische Lüfter sind einfach zu langsam und ineffizient. Gemeinsam senken sie nicht nur die Betriebstemperatur, sondern drücken auch den Energiebedarf und steigern die Zuverlässigkeit der gesamten AI Factory.

Vierfache Trainingsgeschwindigkeit, aber auch mehr Verantwortung

Die Integration spart Platz und erhöht dank neuer Architektur und Confidential Computing die Datensicherheit – ein zentraler Aspekt im aktuellen KI-Wettbewerb. Die Trainingsgeschwindigkeit wächst auf das Vierfache, ohne dass der Stromverbrauch gleichermaßen explodiert. Trotzdem bleibt eine Frage: Wie nachhaltig ist diese Effizienzsteigerung auf Dauer – und wer nutzt sie zuerst?

Alle Augen auf Dell und Nvidia: Die Hauptakteure und ihr Wettlauf um KI-Infrastruktur

Nvidia Blackwell Ultra und Dell PowerEdge: Motoren des neuen KI-Wettbewerbs

Wer die Zukunft der KI-Infrastruktur gestalten will, kommt an zwei Namen nicht vorbei: Nvidia und Dell. Nvidia, langjähriger Taktgeber für Hochleistungs-GPUs, liefert mit der Blackwell Ultra-Generation die Schaltzentrale für aufwendige KI-Berechnungen. Die enorme GPU-Skalierung – bis zu 256 Beschleuniger in einem einzigen Rack – ermöglicht Dell mit seinen neuen PowerEdge XE9680L-Servern. Gemeinsam haben sie im Mai 2025 das KI-Rechenzentrum praktisch neu definiert. Der Launch-Termin war kein Zufall: Die Dringlichkeit für leistungsfähigere, energieeffizientere und sichere KI-Server ist in den letzten Jahren massiv gestiegen.

Teams, Köpfe und Strategien: Dell und Nvidia im Schulterschluss

Die AI Factory-Initiative markiert einen Meilenstein in der Partnerschaft beider Unternehmen. Hinter den Kulissen arbeiten bei Nvidia spezialisierte Teams unter der Leitung erfahrener Hardwareentwickler, während bei Dell insbesondere das PowerEdge-Team federführend agiert. Ihr gemeinsames Ziel: den Flaschenhals der KI-Skalierung endgültig beseitigen. Technische Details wie Direct Liquid Cooling sorgen dafür, dass auch dichte GPU-Konfigurationen energetisch beherrschbar bleiben. Confidential Computing wird direkt in die Serverstruktur integriert, um Datenschutzbedenken möglichst früh zu adressieren.

Marktrelevanz: Wer profitiert – und wann?

Mit der Vorstellung der neuen Dell KI-Server und Nvidia Blackwell Ultra-Prozessoren im Mai 2025 haben beide Unternehmen den Takt im KI-Wettbewerb vorgegeben. Unternehmen, die auf hochskalierbare, sichere und energieeffiziente KI-Rechenzentren setzen wollen, kommen an diesem Ökosystem kaum vorbei. Schon die Markteinführung zeigt: Die Karten für KI-Innovationen werden neu gemischt – und das schneller, als viele erwartet hatten.

Warum Unternehmen jetzt umdenken: Auswirkungen auf Märkte, Energie und Sicherheit

Der technische Sprung – und warum er dringend gebraucht wird

Nvidia Blackwell Ultra-GPUs und Dells neue PowerEdge XE9680L-Server machen deutlich, wie sich KI-Infrastruktur verändert. Bis zu 256 GPUs pro Rack mit vierfacher Trainingsgeschwindigkeit – was auf den ersten Blick wie eine Zahlenspielerei wirken mag, beantwortet eine knallharte Marktrealität: Moderne KI-Modelle wachsen exponentiell, nur durch massive GPU-Skalierung lassen sie sich überhaupt noch wirtschaftlich trainieren oder einsetzen. Wer aktuell in der Halbleiter- und Cloud-Branche nicht massiv aufrüstet, fällt zurück.

Wirtschaftliche Chancen – und neue Risiken

Finanzkräftige Branchen wie Tech, Pharma, Automobil und Finanzdienstleister werden von der neuen Server-Architektur am stärksten profitieren. Sie können große Sprachmodelle, Simulationen und Analysen schneller und effizienter trainieren. Doch damit steigen auch die Investitionen: Ein voll ausgestattetes KI-Rechenzentrum auf dem neuesten Stand markiert eine Einstiegshürde, die kleinere Marktteilnehmer ausbremst. Gleichzeitig verschärft sich der KI-Wettbewerb international: Wer zuerst leistungsfähige AI Factory-Strukturen aufbaut, sichert sich technologische Führerschaft – das sorgt für geopolitische Spannungen, aber auch für Innovationsdruck.

Ökologische und sicherheitstechnische Dimensionen

Die Schattenseite dieser Entwicklung: Energieeffizienz rückt stärker in den Fokus, denn die enorme Dichte von Beschleunigern lässt den Stromverbrauch pro Rack explodieren. Fortschritte wie Direct Liquid Cooling – Flüssigkeitskühlung direkt an den Chips – werden zur Grundvoraussetzung, um die Systeme überhaupt stabil zu betreiben und Wasserverbrauch zu senken. Gleichzeitig müssen vertrauliche Daten durch Confidential Computing besser geschützt werden: Hardware-basiertes Abschotten sensibler Informationen wird zur Pflicht, nicht nur zum Feature. Unternehmen stehen damit technologisch, ökonomisch und ökologisch an einem Wendepunkt, der neues Denken erfordert.

Vermittlung und Reaktion: Wie Dell und Nvidia ihre Innovationen positionieren

Inszenierung auf der großen Bühne

Nvidia und Dell setzten auf maximale Sichtbarkeit und gezielte Ansprache: Die Blackwell Ultra-Architektur und der Dell PowerEdge XE9680L Server wurden prominent auf der NVIDIA GTC vorgestellt – dem Gipfeltreffen für Künstliche Intelligenz und High-Performance-Computing. Auf offiziellen Pressekonferenzen betonten die CEOs beider Firmen die neue Ära der KI-Infrastruktur. Ihre Botschaften richteten sich klar an IT-Entscheider, Data Scientists und Unternehmen mit steigendem Bedarf an KI-Rechenzentrum-Ressourcen.

Technologie als Meilenstein – verständlich und offensiv präsentiert

In den Präsentationen wurde die vierfache Trainingsgeschwindigkeit durch GPU-Skalierung ins Zentrum gerückt, ebenso die Fähigkeit, bis zu 256 GPUs in einem einzelnen Rack nutzbar zu machen. Nvidia und Dell rückten auch energieeffiziente Kühltechnologien wie Direct Liquid Cooling ins Rampenlicht: Flüssigkeitskühlung für mehr Leistung, weniger Stromverbrauch. Bei sicherheitsbewussten Kunden wurde Confidential Computing betont – eine Technologie, die Daten auch während der Verarbeitung schützt.

Reaktionen, Kritik und strategische Weichenstellungen

Die Presse nimmt den Schritt als Startschuss für ein neues KI-Wettrennen wahr: Analysten loben die Kombination aus Rechenleistung und Energieeffizienz. Gleichzeitig werfen Kunden und Kritiker Fragen zur Umsetzung, Versorgungssicherheit und Umweltbelastung auf. Während Dell detaillierte Angaben zur Energieeffizienz und zum Ressourcenbedarf der AI Factory liefert, bleibt Nvidia bislang vage zu möglichen Limits. Beide Unternehmen spielen dabei offen mit der Zukunft: Weitere Innovationen bei Server-Architekturen, Kühlung und Sicherheit werden angekündigt – der KI-Wettbewerb ist in vollem Gang.

Fazit

Blackwell Ultra und die neuen Dell-Server markieren das nächste Level bei KI-Infrastrukturen und definieren die Spielregeln für Unternehmen neu. Der technologische Fortschritt ist beeindruckend, bringt jedoch zugleich große Herausforderungen im Energieverbrauch und bei der Ressourcennutzung mit sich. Wer sich heute aufrüstet, verschafft sich einen Vorsprung im globalen KI-Wettbewerb – sollte aber auch ethische und ökologische Fragen nicht ausblenden. Die Branche steht am Anfang einer spannenden Entwicklung, bei der Innovation, Verantwortung und Effizienz ständig neu austariert werden müssen.

Wie bewerten Sie den KI-Infrastruktursprung von Dell und Nvidia? Diskutieren Sie jetzt in den Kommentaren!

Quellen

Die Engine hinter den KI-Fabriken | NVIDIA Blackwell-Architektur

Dell Technologies und NVIDIA zünden Turbo für KI-Einführung | Dell USA

Dell erweitert KI- und HPC-Funktionen mit PowerEdge XE8712 und verbesserten GPU-Lösungen auf der NVIDIA GTC 2025 – StorageReview.com

Dell unveils new AI servers powered by Nvidia chips to boost enterprise adoption

Dell Technologies Accelerates Enterprise AI Innovation from PC to Data Center with NVIDIA | Dell Technologies

Dell deepens AI push with new PCs, Nvidia-powered servers

NVIDIA Blackwell in Zahlen – die potenziellen Auswirkungen des neuen KI-Superchips von NVIDIA – KI-TechLab

Hinweis: Für diesen Beitrag wurden KI-gestützte Recherche- und Editortools sowie aktuelle Webquellen genutzt. Alle Angaben nach bestem Wissen, Stand: 5/20/2025