Tutorials

Tutorials

Smarte Steckdose einrichten: Geräte sicher per App steuern

Eine smarte Steckdose wirkt simpel, scheitert in der Praxis aber oft an denselben Punkten: falsches WLAN,…

Thema

Alle Beiträge zu diesem Thema auf einen Blick.

Tutorials

Tutorials

Eine smarte Steckdose wirkt simpel, scheitert in der Praxis aber oft an denselben Punkten: falsches WLAN,…

IT Security

IT Security

Vercel hat einen Sicherheitsvorfall auf seiner Entwicklerplattform bestätigt. Nach Angaben des Unternehmens gab es unbefugten Zugriff…

Wirtschaft

Wirtschaft

Speech-to-Text-APIs sind vom Demo-Feature zur einkaufbaren Infrastruktur geworden. Mit dem Start eigenständiger Sprach-APIs von xAI wird…

IT Security

IT Security

Der Fall rund um manipulierte Downloads eines geleakten KI-Tools verweist auf ein dauerhaftes Problem: Bei KI-Coding-Tools…

Updates

Updates

Stand: 25. March 2026, 14:45 Uhr Berlin Auf einen Blick OpenAI stellt die Sora-App und die…

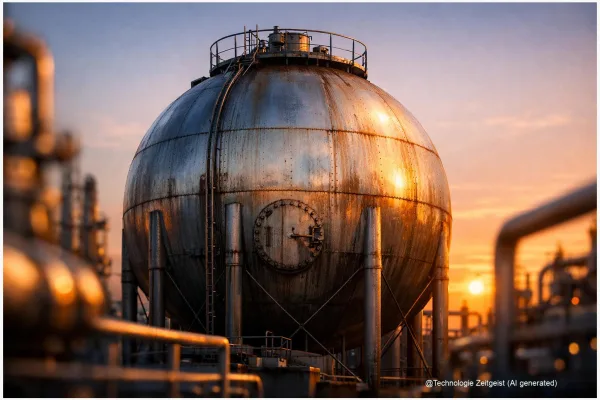

Wirtschaft

Wirtschaft

Die Gaspreise reagieren spürbar auf die Lage rund um die Straße von Hormus. Genau in dieser…

IT Security

IT Security

Stand: 16. March 2026, 17:45 Uhr Berlin Auf einen Blick Claude Code CVE-2026-21852 ermöglichte das Abgreifen…

OpenAI

OpenAI

Stand: 05. March 2026, 23:10 Uhr Berlin Auf einen Blick OpenAI hat GPT-5.4 am Donnerstag mit…

Unternehmen

Unternehmen

Stand: 02. March 2026, 17:45 Uhr Berlin Auf einen Blick Ein weltweiter Claude Ausfall hat am…

Finanzen

Finanzen

Die OpenAI 110 Milliarden Finanzierung durch Amazon, NVIDIA und SoftBank wirkt auf den ersten Blick wie…

KI

KI

Die Claude API ist für viele SaaS-Anbieter, Entwickler und interne IT-Teams im DACH-Raum zur zentralen Infrastruktur…

KI

KI

Wer Anthropic Claude per API in eigene Produkte einbindet, plant Budgets, Verträge und Verfügbarkeit oft Jahre…

OpenAI

OpenAI

Stand: 19. February 2026, 15:46 Uhr Berlin Auf einen Blick OpenAI und die Tata Group haben…

OpenAI

OpenAI

Stand: 14. February 2026, 17:45 Uhr Berlin Auf einen Blick OpenAI hat GPT-4o aus der ChatGPT-Oberfläche…

IT Security

IT Security

KI‑Coding‑Tools beschleunigen Entwicklungsteams, doch falsch abgesicherte Accounts und Tokens können schnell teuer werden. Studien und Incident‑Reports…