KI ist in kritischer Infrastruktur keine normale Bürosoftware mit besserer Automatisierung. Wenn ein Assistenzsystem in der Verwaltung eine Zusammenfassung verhunzt, ist das ärgerlich. Wenn ein KI-gestütztes System in Stromnetzen, Wasserwerken, Krankenhäusern, Verkehr oder Behörden falsche Prioritäten setzt, können daraus Kaskaden entstehen: falsche Schaltvorschläge, übersehene Alarme, blockierte Prozesse, verzögerte Reaktionen oder ein Vertrauen in Empfehlungen, das größer ist als die tatsächliche Belastbarkeit des Systems.

Genau deshalb ist das AI Risk Management Framework des US-Standardsinstituts NIST mehr als ein trockenes Governance-Dokument. Es liefert eine Sprache, um KI-Risiken nicht nur moralisch, sondern betrieblich zu behandeln: Risiken müssen verstanden, gemessen, gesteuert und laufend überwacht werden. NISTs Entwurf eines Cybersecurity-Profils für KI, IR 8596, zeigt zusätzlich, wie eng KI-Sicherheit und klassische Cybersicherheit inzwischen zusammenrücken. Wichtig ist dabei: Der Entwurf ist kein fertiges Sonderregelwerk für jede kritische Infrastruktur. Er ist ein Signal dafür, dass KI-Risiken in realen Betriebsumgebungen genauer gefasst werden müssen.

Warum kritische Infrastruktur anders tickt

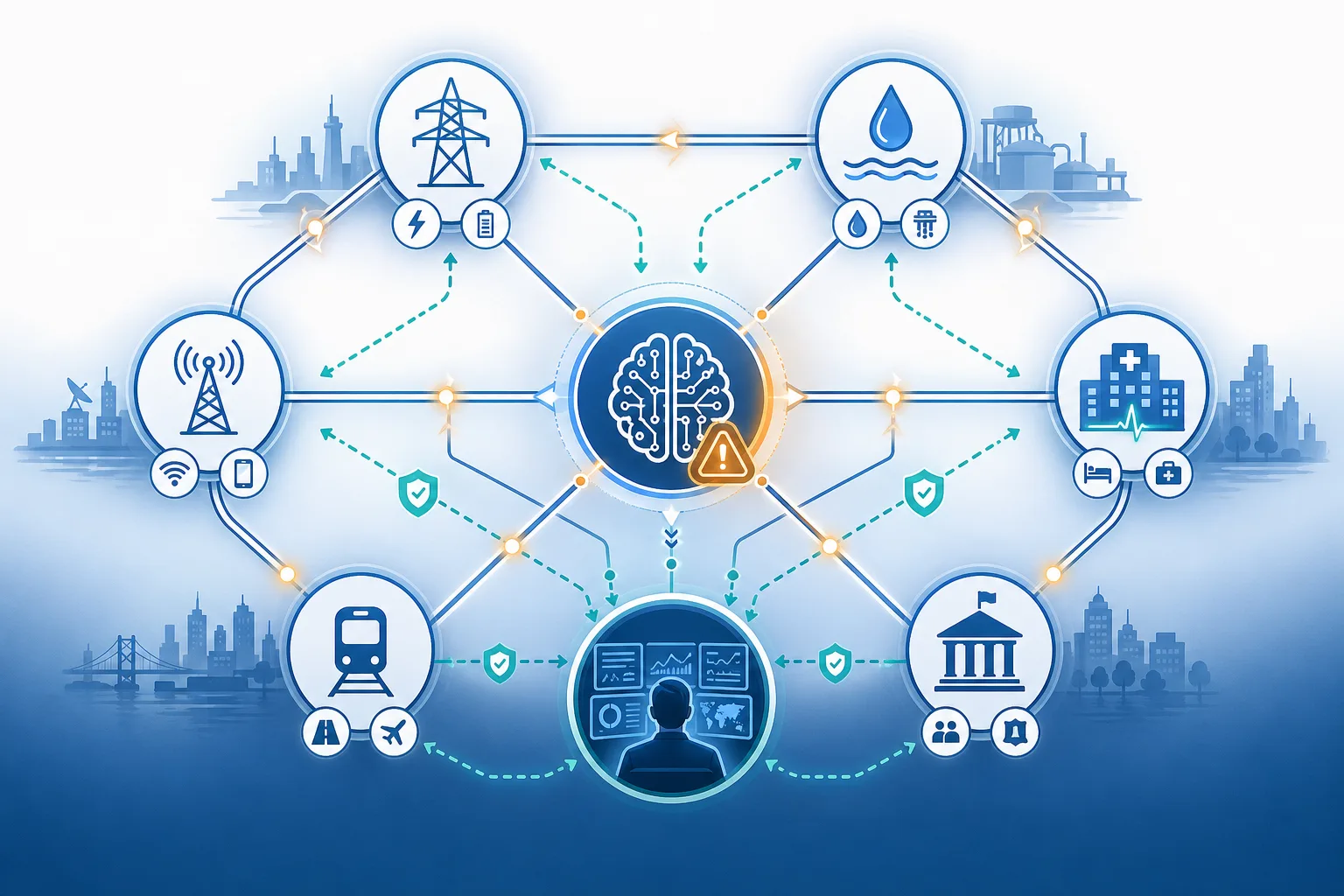

Kritische Infrastruktur hat drei Eigenschaften, die KI-Risikomanagement anspruchsvoller machen. Erstens ist die Fehlertoleranz geringer. Ein unbrauchbarer Textvorschlag lässt sich löschen; eine falsche Empfehlung in einem Leitsystem kann Zeit kosten, Personal binden oder Schutzmechanismen belasten. Zweitens sind Systeme miteinander verknüpft. Strom, Telekommunikation, Wasser, Verkehr, Gesundheitsversorgung und öffentliche Verwaltung hängen nicht sauber getrennt nebeneinander, sondern stützen sich gegenseitig.

Drittens gibt es einen Unterschied zwischen digitalem Fehler und physischer Wirkung. KI kann in kritischen Umgebungen zunächst nur Daten auswerten, Prognosen erstellen oder Entscheidungen vorbereiten. Trotzdem kann eine fehlerhafte Priorisierung dazu führen, dass Menschen die falsche Störung zuerst bearbeiten, Wartung falsch planen oder Sicherheitswarnungen unterschätzen. Das Problem ist dann nicht „die KI hat allein gehandelt“, sondern: Die Organisation hat die Rolle der KI im Entscheidungsprozess nicht sauber begrenzt.

Das NIST AI RMF als Arbeitsrahmen

Das NIST AI RMF beschreibt vertrauenswürdige KI nicht als Produktversprechen, sondern als Managementaufgabe. Besonders hilfreich ist die Aufteilung in Funktionen wie Govern, Map, Measure und Manage. Übersetzt heißt das: Verantwortlichkeiten festlegen, den Anwendungskontext verstehen, Risiken messbar machen und Maßnahmen im Betrieb nachführen. Für kritische Infrastruktur ist diese Reihenfolge entscheidend. Wer sofort über Modellleistung spricht, überspringt die wichtigste Frage: Welche Entscheidung wird hier eigentlich unterstützt, und was passiert, wenn die Empfehlung falsch ist?

Ein Wartungsmodell für Pumpen, ein Prognosemodell für Netzlasten und ein Chatbot für Bürgeranfragen haben völlig unterschiedliche Risikoprofile. Sie können alle „KI“ sein, aber sie brauchen andere Grenzwerte, Tests, Freigaben und menschliche Eingriffsmöglichkeiten. Das NIST-Framework zwingt Organisationen dazu, diese Unterschiede sichtbar zu machen, statt ein generisches KI-Sicherheitsblatt über alle Systeme zu legen.

Safety und Security gehören zusammen

In kritischen Systemen reicht es nicht, KI nur auf Genauigkeit zu prüfen. Ein Modell kann im Test gut abschneiden und im Betrieb trotzdem riskant sein, wenn Eingabedaten manipuliert werden, Sensoren ausfallen, Schnittstellen missbraucht werden oder Angreifer gezielt Grenzfälle erzeugen. Der NIST-Entwurf IR 8596 macht deshalb die Verbindung zwischen KI und Cybersicherheitsprofilen sichtbar: KI-Systeme brauchen Schutz vor Manipulation, aber auch Protokolle, Verantwortliche und Reaktionswege, wenn etwas Ungewöhnliches passiert.

Das ist ein anderer Blick als bei vielen Konsumenten-KI-Debatten. In kritischer Infrastruktur lautet die Frage nicht nur, ob ein Modell halluziniert. Sie lautet auch: Wer erkennt die Abweichung? Welche Protokolle zeigen, was passiert ist? Kann das System in einen sicheren Zustand zurückfallen? Wer darf eine KI-Empfehlung überstimmen? Und wie wird verhindert, dass ein kompromittierter Datenstrom die Organisation in eine falsche Lageeinschätzung schiebt?

Welche Kontrollen wirklich zählen

Ein brauchbares Risikomodell beginnt bei der Datenqualität. Kritische Infrastrukturen arbeiten mit Messwerten, Zustandsdaten, Wartungshistorien, Tickets, Einsatzplänen und externen Signalen. Wenn diese Daten lückenhaft, verspätet oder verzerrt sind, wirkt KI nicht magisch klüger, sondern reproduziert den schlechten Kontext. Darum gehören Datenherkunft, Aktualität, Plausibilitätsprüfungen und Zugriffsschutz in die Freigabe, nicht als spätere Dokumentationsübung.

Danach kommt die Modellvalidierung. Kritische Anwendungen brauchen Tests für Normalbetrieb, Störungen, seltene Ereignisse und Übergänge zwischen Zuständen. Ein System, das im Durchschnitt gut prognostiziert, kann genau in Extremsituationen versagen. Dazu kommen Monitoring und Drift-Erkennung: Ändern sich Lastprofile, Angriffsmuster, Wetterlagen, Anlagenzustände oder Nutzerverhalten, muss auch das KI-System neu bewertet werden. Eine einmalige Abnahme ist bei lernenden oder regelmäßig aktualisierten Systemen zu wenig.

Der Mensch bleibt Teil des Systems

„Human in the loop“ klingt beruhigend, ist aber oft zu ungenau. In kritischer Infrastruktur muss klar sein, welcher Mensch wann eingreift, mit welchen Informationen, unter welchem Zeitdruck und mit welcher Autorität. Eine Bedienerin, die eine KI-Empfehlung in Sekunden prüfen soll, braucht andere Unterstützung als ein Risikogremium, das monatlich Modellkennzahlen bewertet. Menschliche Aufsicht ist nur dann wirksam, wenn sie realistisch gestaltet ist.

Dazu gehört auch Schulung. Fachpersonal muss nicht jedes Modell mathematisch erklären können, aber es muss Warnsignale erkennen: ungewöhnlich selbstsichere Empfehlungen, fehlende Daten, widersprüchliche Anzeigen, sprunghafte Änderungen oder Situationen, in denen das System außerhalb seines vorgesehenen Kontexts genutzt wird. Gute KI-Governance behandelt Menschen nicht als Feigenblatt, sondern als aktive Sicherheitsbarriere.

Beschaffung wird zur Risikofrage

Viele Risiken entstehen nicht erst im Betrieb, sondern beim Einkauf. Wer KI-Funktionen in Plattformen, Leitsystemen oder Cloud-Diensten beschafft, muss mehr fragen als nach Features. Wichtig sind Nachweise zu Trainings- und Betriebsdaten, Update-Prozessen, Schwachstellenmanagement, Logging, Auditierbarkeit, Subdienstleistern, Datenregionen, Modelländerungen und Abschaltmöglichkeiten. Gerade bei kritischen Dienstleistungen müssen Verträge klären, wie schnell Anbieter Sicherheitsprobleme melden und wie Kunden auf Modelländerungen reagieren können.

Hier berührt das Thema auch Regulierung. Der EU AI Act behandelt Hochrisiko-KI, Konformität und Pflichten je nach Einsatzkontext; NIS2 und nationale KRITIS-Regeln verschärfen parallel die Erwartungen an Resilienz und Cybersicherheit. Für Betreiber bedeutet das: KI-Governance darf nicht als isoliertes Innovationsprojekt laufen. Sie muss an Informationssicherheit, Business Continuity, Datenschutz, Lieferantenmanagement und operative Verantwortung gekoppelt sein.

Warum das dauerhaft relevant ist

KI wird in kritischer Infrastruktur wahrscheinlich nicht als großer Schalter auftauchen, der plötzlich alles automatisiert. Sie wird schrittweise in Prognosen, Wartungsplanung, Anomalieerkennung, Dokumentation, Einsatzpriorisierung und Entscheidungsunterstützung einsickern. Genau diese schrittweise Einführung macht robuste Regeln so wichtig: Viele kleine Hilfsfunktionen können zusammen eine Infrastruktur verändern, ohne dass ein einzelnes Projekt wie „die KI übernimmt“ aussieht.

Dauerhaft relevant ist deshalb nicht die Frage, ob eine bestimmte NIST-Veröffentlichung gerade neu ist. Relevant ist der Perspektivwechsel. KI-Risiken in kritischen Systemen sind Betriebsrisiken, Sicherheitsrisiken und Governance-Risiken zugleich. Wer sie ernst nimmt, braucht klare Rollen, nachvollziehbare Datenflüsse, harte Grenzen für Automatisierung, Tests für Ausnahmesituationen, laufendes Monitoring und geübte Rückfallprozesse.

Was Betreiber und Entscheider jetzt mitnehmen sollten

Der praktische Startpunkt ist ein Inventar: Wo wird KI bereits genutzt, welche Entscheidungen beeinflusst sie, welche Daten verwendet sie, und welche Folgen hätte ein Fehler? Danach sollten Organisationen Anwendungen nach Kritikalität sortieren. Ein internes Recherchetool braucht andere Kontrollen als ein System, das Einsatzteams priorisiert oder technische Störungen bewertet. Für die besonders sensiblen Fälle sollten Freigabe, Monitoring, Incident Response und Abschaltung vor dem Produktivbetrieb geklärt sein.

Gute KI in kritischer Infrastruktur ist am Ende weniger spektakulär, als viele Debatten vermuten lassen. Sie ist dokumentiert, begrenzt, überprüfbar und im Notfall ersetzbar. Genau das macht sie nützlich. Nicht weil sie unfehlbar wäre, sondern weil die Organisation ihre Fehler einkalkuliert, erkennt und abfangen kann.

Quellen

- NIST — AI Risk Management Framework

- NIST IR 8596 ipd — Cybersecurity Framework Profile for Artificial Intelligence

- NIST — Artificial Intelligence Standards

- CISA — Critical Infrastructure Sectors

- European Commission — Regulatory framework on artificial intelligence

Hinweis: Für diesen Artikel wurden KI-gestützte Recherche- und Editierwerkzeuge verwendet. Der Inhalt wurde menschlich redaktionell geprüft. Stand: 29. April 2026.