Enterprise-Privacy klingt nach einem beruhigenden Versprechen: Geschäftsdaten bleiben geschützt, Chats trainieren keine allgemeinen Modelle, Admins behalten Kontrolle. In der Praxis ist es komplizierter. Bei ChatGPT Enterprise, Microsoft 365 Copilot und Gemini entscheiden nicht nur die Modellnamen, sondern Vertragsmodell, Tenant-Einstellungen, Datenaufbewahrung, Berechtigungen, Protokolle und die Frage, welche internen Systeme angebunden werden.

Genau deshalb sollte man Enterprise-Privacy nicht als Marketinglabel lesen, sondern als Prüfliste. Ein KI-Dienst kann für Routineaufgaben sehr produktiv sein und trotzdem ungeeignet für bestimmte Kundendaten, Personalvorgänge oder strategische Dokumente bleiben. Umgekehrt ist nicht jede Cloud-Verarbeitung automatisch ein No-Go, wenn Zweckbindung, Zugriffsschutz und Löschregeln sauber geregelt sind.

Der Kern: Enterprise-Privacy ist ein Paket, kein einzelner Schalter

Bei generativer KI entstehen Datenschutzfragen an mehreren Stellen gleichzeitig. Eingaben können personenbezogene Daten, Geschäftsgeheimnisse oder Kundendokumente enthalten. Antworten können vertrauliche Zusammenfassungen erzeugen. Integrationen holen Kontext aus E-Mail, Kalender, Dateien oder CRM-Systemen. Und Administratoren müssen nachvollziehen können, wer welche Funktionen mit welchen Rechten nutzt.

OpenAI betont für Enterprise-Angebote, dass Kundendaten nicht standardmäßig zum Training verwendet werden und Organisationen Kontrolle über Daten und Aufbewahrung erhalten. Microsoft beschreibt Microsoft 365 Copilot als Dienst, der innerhalb der vorhandenen Microsoft-365-Sicherheits- und Compliance-Grenzen arbeitet und bestehende Berechtigungen respektieren soll. Google positioniert Sicherheits- und Governance-Werkzeuge rund um generative KI ebenfalls als Unternehmensfunktion. Das sind wichtige Anbieterangaben – aber sie ersetzen keine eigene Prüfung.

1. Training: Werden Arbeitsdaten für Modellverbesserung genutzt?

Die erste Frage lautet schlicht: Fließen Prompts, hochgeladene Dateien oder Antworten in das Training allgemeiner Modelle? Für Unternehmen ist das oft der sichtbarste Unterschied zwischen Verbraucher- und Enterprise-Tarifen. Ein Trainingsausschluss reduziert das Risiko, dass interne Informationen indirekt in spätere Modellverbesserungen eingehen. Er bedeutet aber nicht, dass Daten niemals verarbeitet, zwischengespeichert oder von angebundenen Diensten genutzt werden.

Praktisch wichtig ist deshalb die genaue Formulierung: Gilt der Ausschluss für alle Produkte im Vertrag? Für APIs, Chat-Oberflächen, Plugins, Konnektoren und Analysefunktionen? Was passiert mit Feedback, Supportfällen oder Missbrauchsprüfungen? Wer nur „wird nicht trainiert“ liest, übersieht oft die Nebenwege.

2. Retention: Wie lange bleiben Prompts, Dateien und Logs erhalten?

Datenaufbewahrung ist weniger sexy als Modellqualität, aber im Betrieb entscheidend. Manche Organisationen brauchen kurze Löschfristen, andere müssen Protokolle für Compliance, Security oder Nachvollziehbarkeit länger halten. Enterprise-Privacy heißt nicht automatisch „sofort gelöscht“. Es heißt: Die Aufbewahrung muss erklärbar, konfigurierbar und zur eigenen Datenklassifizierung passend sein.

Teams sollten klären, ob Chatverläufe, hochgeladene Dateien, Audit-Logs, Sicherheitsereignisse und Admin-Berichte getrennte Fristen haben. Auch wichtig: Können Nutzer lokale Kopien, Exporte oder geteilte Links erzeugen? Datenschutz scheitert selten nur am Modell. Häufig scheitert er daran, dass Inhalte nach der KI-Nutzung in unkontrollierten Ablagen weiterleben.

3. Zugriff: KI übernimmt die Berechtigungsprobleme der Organisation

Besonders bei Copilot-ähnlichen Systemen ist ein alter IT-Grundsatz wieder aktuell: Wenn Berechtigungen im Dateisystem zu breit sind, findet auch ein KI-Assistent zu viel. Microsoft weist darauf hin, dass Copilot vorhandene Microsoft-365-Berechtigungen nutzt. Das ist gut, wenn Berechtigungen sauber gepflegt sind. Es ist riskant, wenn alte SharePoint-Bibliotheken, Gruppenlaufwerke oder Teams-Kanäle historisch gewachsen sind.

Vor einem Rollout sollten Unternehmen daher nicht nur KI-Richtlinien schreiben, sondern Berechtigungen aufräumen. Wer darf Personalakten sehen? Wer darf Verträge durchsuchen? Welche Projektordner enthalten Kundengeheimnisse? KI macht solche Altlasten sichtbarer, weil sie Informationen schneller zusammenführen kann als Menschen per manueller Suche.

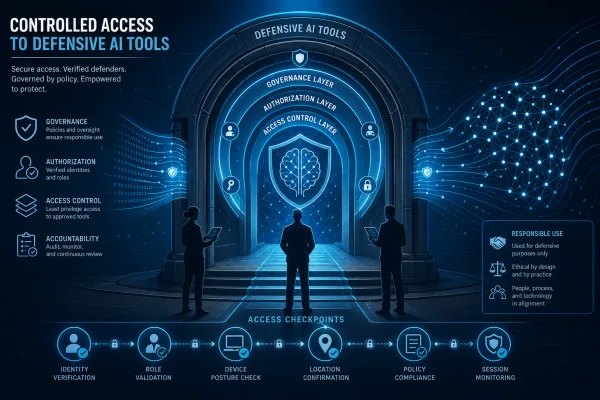

4. Admin-Kontrollen: Produktivität braucht Leitplanken

Enterprise-KI wird erst beherrschbar, wenn Administratoren Funktionen gezielt freigeben können. Dazu gehören Nutzergruppen, Datenquellen, Konnektoren, Dateiuploads, externe Tools, Modelloptionen und eventuell regionale Verarbeitung. Ein Unternehmen kann beispielsweise interne Wissenssuche erlauben, aber Kundendaten-Uploads, Webzugriff oder Drittanbieter-Plugins sperren.

Diese Leitplanken sind kein Misstrauensvotum gegen Mitarbeitende. Sie schaffen die Grundlage dafür, dass KI breiter genutzt werden kann, ohne jede Eingabe einzeln juristisch zu prüfen. Gute Governance trennt Alltag, vertrauliche Arbeit und Hochrisikofälle. Das passt auch zum NIST AI Risk Management Framework, das Risiko nicht als Einmalprüfung, sondern als laufenden Managementprozess behandelt.

5. Auditierbarkeit: Man muss später noch wissen, was passiert ist

Wenn KI in echte Geschäftsprozesse wandert, reicht „hat funktioniert“ nicht. Organisationen brauchen Protokolle: Welche Nutzer haben welche Funktionen aktiviert? Welche Datenquellen waren angebunden? Welche Admin-Änderungen wurden vorgenommen? Gab es sicherheitsrelevante Ereignisse? Auditierbarkeit ist nicht nur für Behörden oder Konzerne relevant. Sie hilft auch kleinen Teams, Fehler nachzuvollziehen und Regeln zu verbessern.

Gleichzeitig darf Audit nicht zur heimlichen Totalüberwachung werden. Unternehmen sollten transparent machen, welche Nutzungsdaten protokolliert werden und wofür. Datenschutz und Sicherheit stehen hier nicht gegeneinander; sie brauchen eine saubere interne Regelung.

ChatGPT, Copilot und Gemini: Die richtigen Vergleichsfragen

Ein fairer Vergleich fragt nicht: „Welcher Dienst ist am privatesten?“ Die bessere Frage lautet: „Welcher Dienst passt zu unserem Datenmodell, unseren bestehenden Systemen und unseren Nachweispflichten?“ ChatGPT Enterprise kann attraktiv sein, wenn Teams einen starken universellen KI-Arbeitsplatz suchen. Microsoft 365 Copilot ist eng mit M365-Daten und vorhandenen Berechtigungen verbunden. Gemini-Angebote spielen ihre Stärke dort aus, wo Google-Workspace- oder Google-Cloud-Umgebungen ohnehin gesetzt sind.

- Gibt es einen klaren Trainingsausschluss für Kundendaten?

- Sind Retention- und Löschregeln dokumentiert und administrierbar?

- Respektiert der Dienst bestehende Berechtigungen – und sind diese Berechtigungen sauber?

- Welche Konnektoren, Plugins und externen Tools sind erlaubt?

- Welche Audit- und Exportfunktionen gibt es für Security und Compliance?

- Ist geregelt, welche Datenklassen überhaupt in KI-Dienste dürfen?

Was Teams vor dem Rollout konkret festlegen sollten

Vor der Freigabe lohnt sich eine kurze, aber verbindliche Betriebsvereinbarung: Welche Datenklassen sind erlaubt, welche bleiben tabu, wer genehmigt neue Konnektoren und wie werden Vorfälle gemeldet? Gerade bei KI-Assistenten ist diese Klarheit wichtiger als lange Grundsatzpapiere. Mitarbeitende müssen in wenigen Sätzen verstehen, ob ein Vertragsentwurf, ein Kundenprotokoll oder ein Quellcodeausschnitt in den Dienst darf.

Ebenso wichtig ist ein Test mit realistischen, aber nicht sensiblen Beispielen. Dabei zeigt sich, ob Berechtigungen sauber greifen, ob Admins die richtigen Protokolle sehen und ob Antworten Quellen oder Dokumentkontext nachvollziehbar nutzen. Erst danach sollte der Kreis der Nutzer wachsen. Enterprise-Privacy ist damit weniger ein Häkchen im Einkauf als ein wiederholbarer Prozess: konfigurieren, testen, messen, nachschärfen.

Warum das dauerhaft relevant ist

KI-Dienste werden normaler Bestandteil digitaler Arbeit. Genau deshalb verschiebt sich die Debatte: Es geht nicht mehr nur darum, ob ein Team ChatGPT, Copilot oder Gemini ausprobieren darf. Es geht darum, ob KI dauerhaft in Wissensarbeit, Support, Entwicklung, Vertrieb oder Verwaltung eingebaut werden kann, ohne Datenkontrolle zu verlieren.

Enterprise-Privacy ist dabei kein Zielzustand, den man einmal einkauft. Sie ist ein Betriebsmodell. Anbieter liefern technische und vertragliche Bausteine. Unternehmen müssen daraus Regeln, Rollen, Datenklassifizierung, Schulung und Kontrolle machen. Wer diese Arbeit früh erledigt, bekommt mehr als Compliance: Er schafft Vertrauen, damit KI nicht nur heimlich in Einzelfällen, sondern produktiv und verantwortbar genutzt werden kann.

Quellen

- OpenAI: Enterprise privacy at OpenAI

- Microsoft Learn: Data, Privacy, and Security for Microsoft 365 Copilot

- Google Cloud: Generative AI data governance

- NIST AI Risk Management Framework

- EU Commission: AI Act regulatory framework

Hinweis: Für diesen Artikel wurden KI-gestützte Recherche- und Editierwerkzeuge verwendet. Der Inhalt wurde menschlich redaktionell geprüft. Stand: 1. Mai 2026.