OpenAI will sein Trusted-Access-Programm für Cyberabwehr deutlich ausweiten. Laut einer Ankündigung vom 14. April 2026 sollen künftig mehr verifizierte einzelne Verteidiger und mehrere hundert Teams Zugang zu stärkeren Cyber-KI-Funktionen erhalten. Wichtig ist dabei die Einschränkung: Es geht nicht um eine pauschale Freischaltung für alle, sondern um kontrollierten Zugang für defensive Sicherheitsarbeit.

OpenAI beschreibt die Ausweitung als Versuch, leistungsfähigere Modelle dort nutzbar zu machen, wo sie Schwachstellenanalyse, Incident Response oder Sicherheitsforschung beschleunigen können. Gleichzeitig bleibt der Zugang an Prüfungen und Regeln gebunden. Genau dieser Spagat macht die Meldung relevant: Je stärker KI-Modelle bei Cyberaufgaben werden, desto wichtiger wird die Frage, wer welche Fähigkeiten unter welchen Bedingungen nutzen darf.

Was OpenAI konkret ankündigt

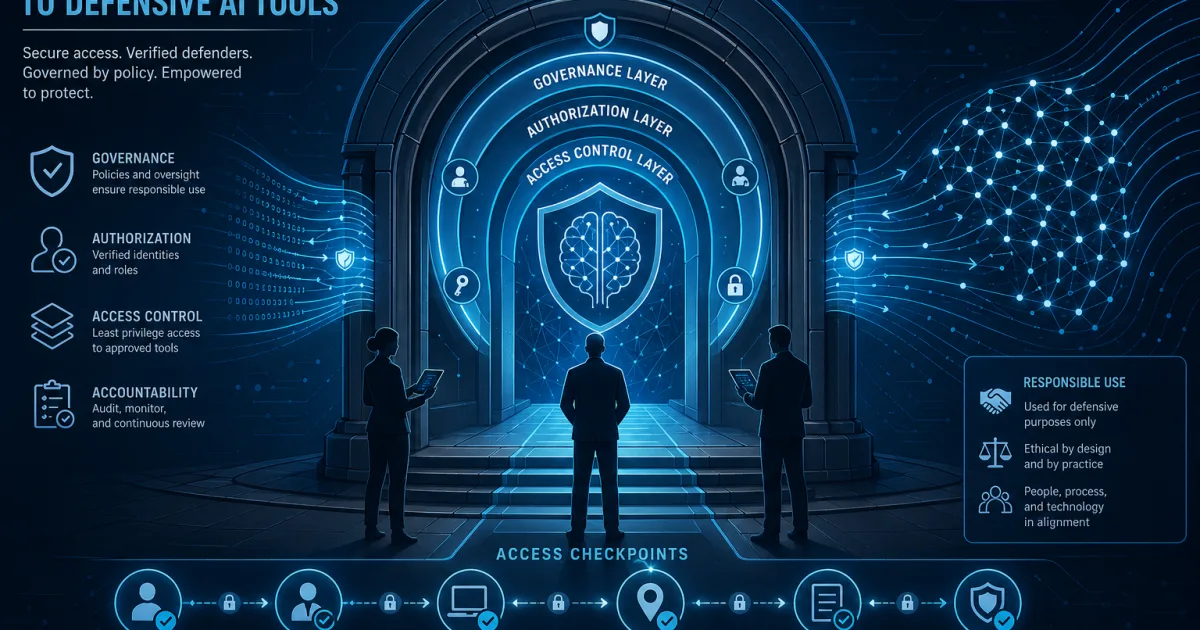

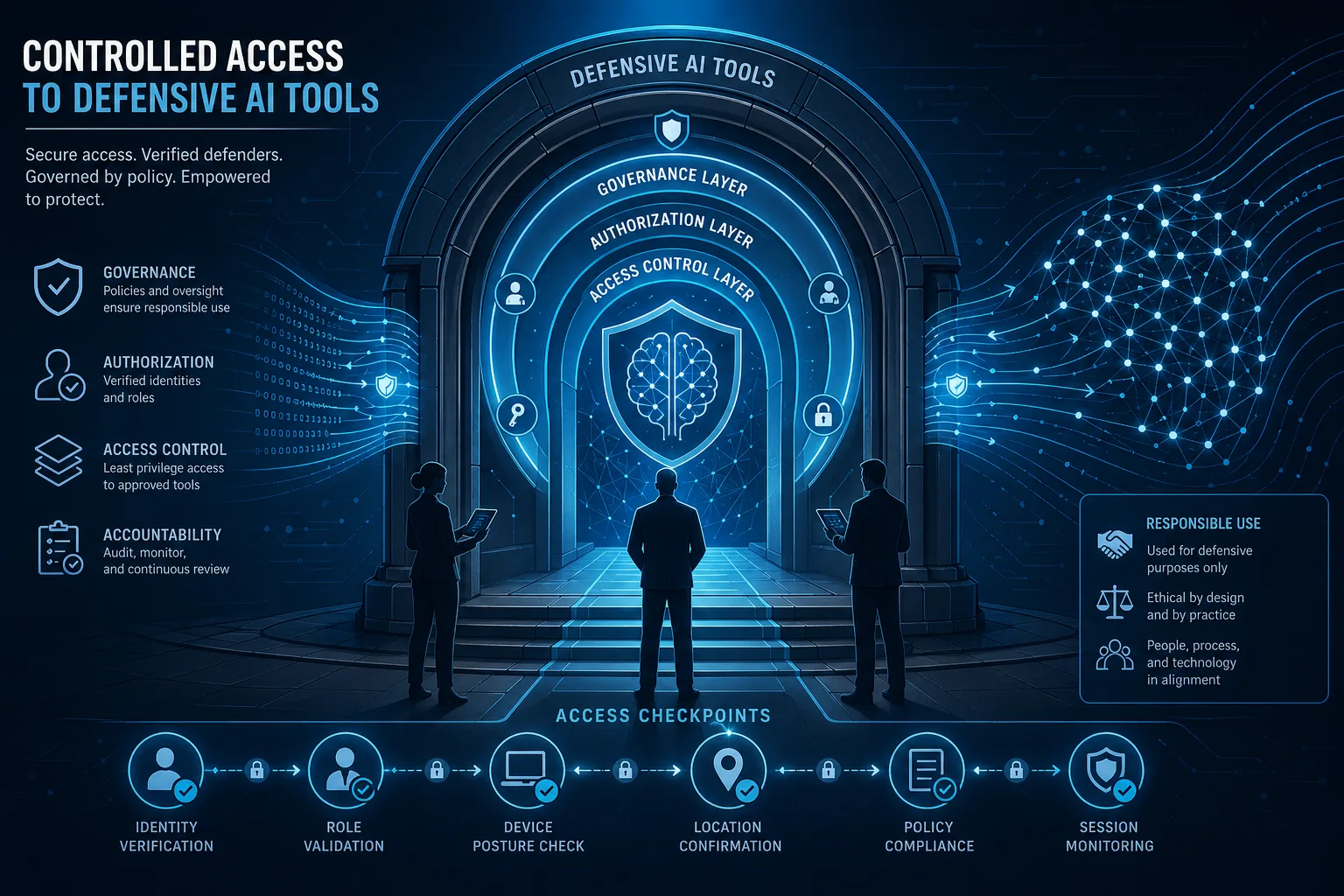

Im Kern geht es um „Trusted Access“: ein Programm, das verifizierten Sicherheitsfachleuten Zugriff auf Funktionen geben soll, die für defensive Cybersecurity gedacht sind. OpenAI nennt als Zielgruppe unter anderem einzelne Defender, Forschungsteams und Organisationen, die legitime Schutzarbeit leisten. Zusätzlich erwähnt das Unternehmen eine cyber-permissivere Modellvariante namens GPT-5.4-Cyber, die für defensive Anwendungsfälle gedacht ist.

Die Formulierung ist wichtig. OpenAI sagt nicht, dass solche Fähigkeiten frei im öffentlichen Chatfenster landen. Der Anbieter stellt die Ausweitung vielmehr als kontrollierte Schicht zwischen allgemeinem Modellzugang und spezialisierten Hochrisiko-Funktionen dar. Damit rückt eine Governance-Frage in den Vordergrund, die die ganze KI-Branche betrifft.

Warum Cyber-KI heikel ist

Cybersecurity ist ein Doppelverwendungsfeld. Dieselben Werkzeuge, die Verteidigern helfen, Logdaten zu sortieren, verdächtige Muster zu erkennen oder Code auf Schwachstellen zu prüfen, können in falschen Händen auch Missbrauch erleichtern. Deshalb sind pauschale Aussagen wie „mehr KI ist automatisch sicherer“ oder „mehr KI ist automatisch gefährlicher“ zu schlicht.

Der sinnvolle Maßstab ist genauer: Welche Fähigkeiten werden freigeschaltet, für wen, mit welcher Kontrolle und für welchen Zweck? Ein verifiziertes Incident-Response-Team hat andere Anforderungen als ein anonymer Nutzer. Eine Universität, die Abwehrmechanismen erforscht, braucht andere Freiheiten als ein Bot, der massenhaft Exploit-Ideen abfragt. Trusted Access ist OpenAIs Antwort auf diese Abstufung.

Was Verteidiger davon haben könnten

Für Sicherheitsteams kann ein stärkeres Cyber-Modell vor allem Zeit sparen. Es kann lange technische Dokumente zusammenfassen, verdächtige Skriptfragmente erklären, Hypothesen für eine Ursachenanalyse sortieren oder aus vielen Signalen eine priorisierte Prüfliste machen. In großen Organisationen ist diese Sortierleistung oft wertvoller als ein einzelner spektakulärer Modelltrick.

Gerade kleinere Teams könnten profitieren, wenn sie bessere Assistenz bei Routineanalyse und Dokumentation erhalten. Ein Modell ersetzt keine erfahrene Sicherheitsanalystin, aber es kann repetitive Arbeit reduzieren. Entscheidend bleibt, dass Ergebnisse überprüft werden. Cyber-KI darf nicht zur Autorität werden, die ungeprüft Alarmketten oder Gegenmaßnahmen auslöst.

Wo die Risiken liegen

Das größte Risiko ist Übervertrauen. Wenn Anbieter besonders leistungsfähige Modelle für Cyberabwehr bewerben, klingt das schnell nach einem Schutzschild gegen alle Angriffe. Das ist es nicht. KI kann Fehler machen, Zusammenhänge übersehen oder unsichere Schlussfolgerungen überzeugend formulieren. Außerdem müssen Unternehmen klären, welche Daten sie in solche Systeme geben dürfen.

Ein zweites Risiko ist Grenzverschiebung. Was heute nur verifizierten Teams offensteht, könnte morgen breiter verfügbar werden – oder durch konkurrierende Anbieter anders gehandhabt werden. Deshalb ist nicht nur OpenAIs konkretes Programm interessant, sondern das entstehende Prinzip: Hochrisiko-Fähigkeiten werden nicht einfach „an“ oder „aus“ geschaltet, sondern nach Nutzergruppe, Zweck und Sicherheitsniveau gestuft.

Einordnung für Unternehmen

Für IT- und Security-Leitungen ist die Nachricht ein Hinweis, ihre KI-Governance praktischer zu denken. Es reicht nicht, generative KI allgemein zu erlauben oder zu verbieten. Unternehmen brauchen Rollenmodelle, Protokollierung, Datenregeln und klare Verantwortlichkeiten. Wer ein spezialisiertes Cyber-KI-Werkzeug nutzt, sollte dokumentieren, welche Aufgaben erlaubt sind und wo menschliche Freigabe nötig bleibt.

OpenAIs Trusted-Access-Ausbau zeigt damit einen wahrscheinlichen Trend: Die mächtigsten KI-Funktionen werden künftig nicht überall gleich verfügbar sein. Stattdessen entstehen Zugangsmodelle, die Vertrauen, Identität und Einsatzzweck berücksichtigen. Ob das in der Praxis robust genug ist, hängt an der Prüfung der Teilnehmer, an Missbrauchserkennung und an transparenter Kommunikation über Grenzen.

Ausblick

Die Ankündigung ist kein Freifahrtschein für autonome Cyberoperationen. Sie ist eher ein Testfall dafür, wie KI-Anbieter mit Fähigkeiten umgehen, die nützlich und riskant zugleich sind. Für Verteidiger kann kontrollierter Zugang ein echter Vorteil sein. Für die Branche ist er ein Signal: Bei Sicherheits-KI wird nicht nur Modellleistung zählen, sondern auch die Qualität der Zugangsregeln.

Wenn dieses Modell funktioniert, könnte es zum Muster für weitere Hochrisiko-Bereiche werden – von Biosecurity bis Finanzbetrugsabwehr. Wenn es scheitert, werden Regulierer und Kunden genauer fragen, ob Anbieter ihre stärksten Systeme wirklich kontrollieren können.

Quellen

- OpenAI: Trusted access for the next era of cyber defense

- OpenAI: Trusted Access for Cyber

- OpenAI: GPT-5.5 System Card

- The Hacker News: OpenAI launches GPT-5.4-Cyber with expanded access for security teams

Hinweis: Für diesen Artikel wurden KI-gestützte Recherche- und Editierwerkzeuge verwendet. Der Inhalt wurde menschlich redaktionell geprüft. Stand: 30. April 2026.