Inhaltsübersicht

Einleitung Begriff, Auslöser und Status: Was Agenten heute messbar leisten Wie Agenten entscheiden: Architektur, Schnittstellen und Kontrolle Ökonomie und Pfade: Geschäftsmodelle und Szenarien bis fünf Jahre Folgen, Gegenbeweise und harte Prüfsteine für die Zukunft FazitEinleitung

Agentische KI verspricht Software, die nicht nur Antworten erzeugt, sondern eigenständig Ziele verfolgt, Tools nutzt und Ergebnisse kontrolliert. Doch wie weit ist die Autonomie tatsächlich – und wo endet der Hype? Dieser Artikel sortiert messbare Fakten: konkrete Produkt‑Launches, Benchmarks, real eingesetzte Workflows und dokumentierte Vorfälle. Wir zeigen, wie moderne Agenten planen, handeln, sich Feedback holen und welche Governance‑Kontrollen in produktiven Umgebungen greifen. Dazu kommen harte Zahlen zu Märkten und Finanzierungen, die wichtigsten Player zwischen Open Source und Big Tech sowie ein Blick auf Sicherheitsrisiken wie Prompt‑Injection oder Datenlecks. Im zweiten Schritt geht es um die ökonomischen Modelle hinter dem Trend und realistische Szenarien für die nächsten Jahre – inklusive klarer Trigger, an denen sich Vorhersagen testen lassen. Ziel: eine nüchterne, fundierte Grundlage, um Investitionen, Deployments und Regulierungsentscheidungen heute besser abwägen zu können.Begriff, Auslöser und Status: Was Agenten heute messbar leisten

Agentic AI bezeichnet heute KI‑Systeme, die selbstständig Pläne erstellen, Tools aufrufen und Aufgaben in produktiven Umgebungen abschließen. Das prägendste, öffentlich diskutierte Beispiel sind produktive Coding‑Agenten (z. B. Devin), plus neue Agent‑Tooling‑APIs, die den Begriff von Forschung in reale Deployments überführen.Messbare Agentenleistung zeigt sich in Tool‑Nutzung, Task‑Abschlussrate und Observability‑Metriken(Cognition AI, 2024-09-12).

Ereignis‑Timeline (letzte 12 Monate)

- 2024-09-12 — Cognition AI: „A review of OpenAI’s o1…“ — Praxisreport zu Devin als Coding‑Agent; dokumentiert o1‑Integration, Evaluationstools und reale Fehlerfälle

(Cognition AI)

Quelle. - 2024-05 (Google I/O) — Project Astra/Agent‑Demos — Google zeigte multimodale, handlungsfähige Assistenten mit Browser‑ und Toolzugriff; Beleg für breite Industrie‑Fokussierung auf Agenten.

- 2025-03-11 — OpenAI: „New tools for building agents“ — Launch von Responses‑APIs, Agents‑SDK und Observability‑Features; erleichtert Produktions‑Deployments und Monitoring

(OpenAI)

Quelle.

Markt, Deployments & Akteurslandschaft

Status quo: Konkrete, verifizierte Umsatzzahlen für “Agentic AI” als Marktsegment liegen nicht zentral vor; Anbieter‑Features erscheinen als Add‑ons großer Cloud‑Anbieter (OpenAI, Google, AWS/Microsoft‑Integrationen). Öffentliche, dokumentierte Finanzierungsrunden: Cognition AI kommunizierte Produkt‑Fokus und Pilotkunden (siehe Cognition Blog). Für Benchmarks existieren SWE‑bench (Software‑Engineering), AgentBench (multi‑env), WebArena (Web‑Tasks) und AgentHarm (Safety) als primäre Evaluations‑Frameworks; ihre Metriken umfassen Task‑success‑rate, plan‑robustness und safety‑violation‑rates. Branchen: Softwareentwicklung (Coding‑Agenten), Kundenservice/Automation, Forschung & Entwicklung und Browser‑Task‑Automation. Öffentliche Audits/Benchmarks sind fragmentiert; unabhängige Validierungen fehlen oft. Weiterführende Lektüre: Nächstes Kapitel: Wie Agenten entscheiden: Architektur, Schnittstellen und KontrolleWie Agenten entscheiden: Architektur, Schnittstellen und Kontrolle

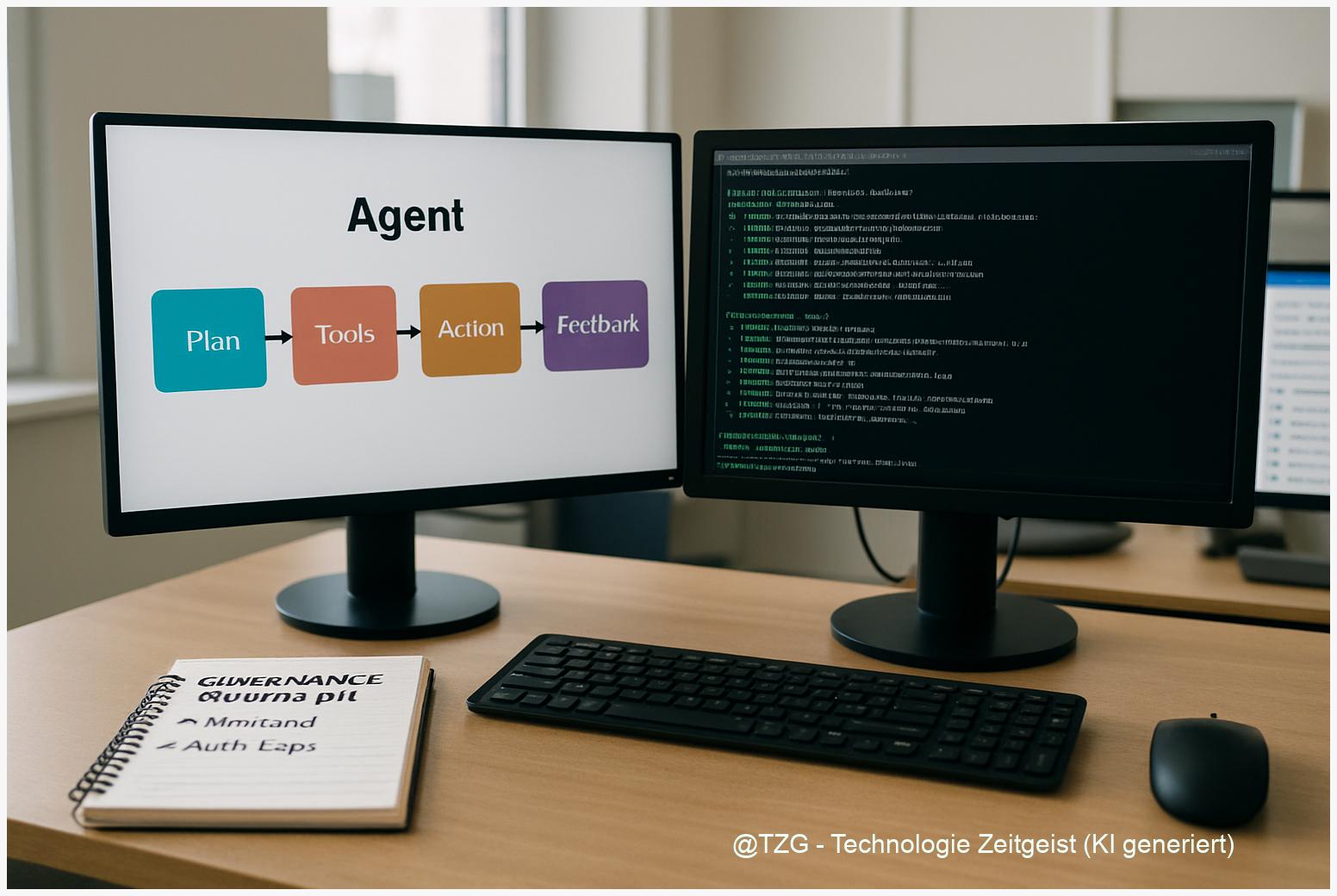

Agentic AI trifft Entscheidungen in wiederkehrenden Phasen: Input → Planung → Tool‑Aufruf → Aktion → Feedback. Dieser Ablauf bestimmt, wer Verantwortung trägt und welche technischen Kontrollen greifen.Produktive Agenten koordinieren LLM‑Planning mit spezialisierten Tools und Observability‑Logs(Cognition AI, 2024-09-12).

Operativer Ablauf (schrittweise)

- Input: Nutzerprompt, System‑Kontext, externe Events. Letzte Entscheidungsbefugnis: Nutzer/Betreiber für Scope; Algorithmus für Repräsentation. Governance: Rate‑Limits, Policy‑Filter, Auth‑Tokens (OpenAI Agents‑APIs) (OpenAI, 2025-03-11).

- Planung/Internale Module: Planner (chain‑of‑thought/ToT), Memory, Verifier. Letzte Befugnis: Algorithmus bei kurzfristigen Schritten; Entwickler bei Modell‑Design. Implementiert: sandboxed tool‑interfaces, step‑level audit‑logs.

- Tool‑Aufruf/Action: APIs, function invocations, Browser/Shell/Editor‑Plugins. Letzte Befugnis: Betreiber (Policy/Governance), Nutzer für explizite Genehmigungen. Technik: OAuth, capability‑scoped keys, approval‑gates.

- Externer Effekt & Feedback: Output, Monitoring, Reward‑Signals. Letzte Befugnis: Betreiber für Retraining/Shutdown. Implementiert: observability, anomaly‑detectors, human‑in‑the‑loop escalation.

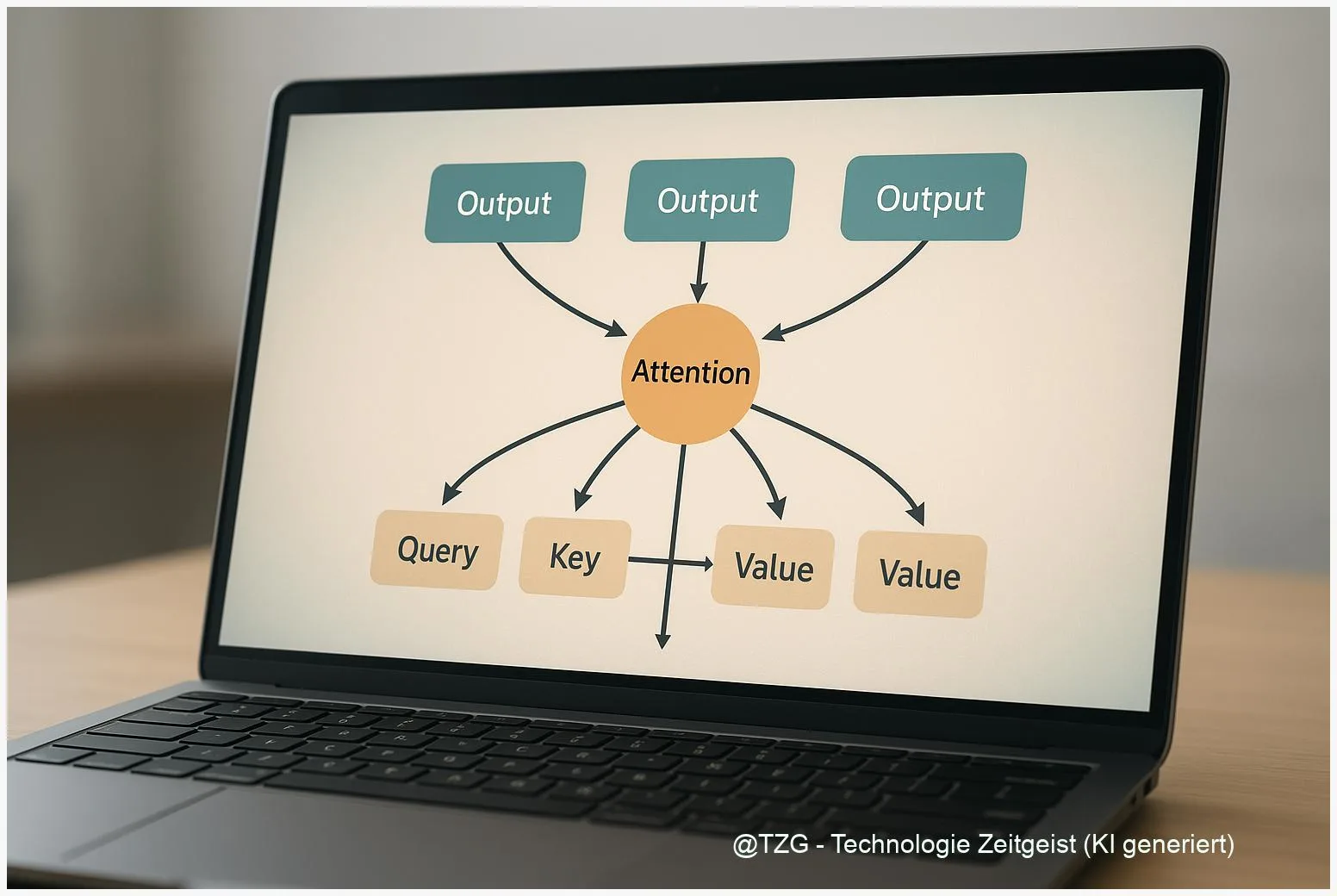

Architekturen, Trainingsmethoden und Schnittstellen

Gängige Muster: plan‑act‑reflect, modular tool‑use und Multi‑Agent‑Orchestrierung. Trainingsmethoden umfassen RLHF/RLAIF für Verhaltensrichtung, Offline‑RL für historische Policies, Toolformer‑ähnliche Präparate zur Tool‑Invocation und CoT/ToT für Planning. Schnittstellen: REST/gRPC‑APIs, function calls, browser automation. Metriken: task‑success‑rate (SWE‑bench), calibration, reward‑hacking‑checks und safe‑exploration KPIs (AgentBench/WebArena‑Familie). Für Coding‑Agenten dokumentiert Cognition AI den Wechsel von GPT‑4o zu o1 in produktiven Tests mit Evaluator‑Agenten (Cognition AI, 2024-09-12).Failure‑Modes und Governance

Häufige Feldfehler: Prompt‑Injection, Tool‑Abuse (unerlaubte API‑Calls), Data‑Exfiltration und Halluzinationen. OpenAI benennt Policy‑Filters, capability‑scoping, audit‑logs und approval‑gates als reale Gegenmaßnahmen (OpenAI, 2025-03-11). Unabhängige Governance‑Vorschläge diskutieren dezentrale Audit‑Register und Agent‑IDs zur Nachvollziehbarkeit (Decentralized Governance, 2024-12-24). Grafikbeschreibung: Datenflussdiagramm zeigt Pfeile von Nutzer → Planner → Tool‑Invoker → externe API → Monitoring; an jeder Schnittstelle sitzen Policy‑Gate, Auth‑Layer und Audit‑Log, die Entscheidungen dokumentieren und menschliche Eingriffe ermöglichen. Limitierung: Quantitative Häufigkeiten zu Fehlermodi sind öffentlich fragmentiert; systematische Felddaten fehlen oft.Ökonomie und Pfade: Geschäftsmodelle und Szenarien bis fünf Jahre

Agentic AI wandelt Geschäftsmodelle: Plattform‑Gebühren, Agent‑Marktplätze und Ergebnis‑basierte SaaS‑Tarife ersetzen simple Token‑Abrechnung. Anbieter sammeln nicht nur Modelle, sondern auch Tool‑Integrationen und Nutzungsdaten, die zu Wettbewerbsvorteilen führen.Das treibt sowohl Monetarisierung als auch Lock‑in‑Risiken(CloudZero, 2025-08-19).

Geschäftsmodelle & Anreize

Typen: 1) SaaS‑Automatisierung mit nutzungsbasierter Abrechnung; 2) Entscheidungs‑as‑a‑Service (ermittelt gegen Gebühr) mit SLA/Governance; 3) Agent‑Marktplätze, die Tools und Daten kuratieren; 4) Integrations‑/Support‑Services. Wer profitiert? Cloud‑Provider und Plattformbetreiber verdienen an API/Tool‑Fees und Marketplace‑Provisionen. Kunden tragen Kosten für Inference und Integrationen; Arbeitnehmer tragen Umschulungs‑ und Produktivitätsrisiken.AWSʼ AI Index nennt Cloud‑Kosten und FinOps als zentrale Entscheidungstreiber(AWS, 2025-04-18).

Finanzierung & Messgrößen

VC‑Investment fließt in Agent‑Startups und Tooling. Wichtige KPIs: Cost‑per‑action, Time‑to‑value, ROI pro Agent‑Instance. Benchmarks wie SWE‑bench, AgentBench oder WebArena messen Coding‑Performance und Task‑Success‑Rates; sie bestimmen Marktakzeptanz (AIwire, 2025-03-28).Szenarien & Trigger

1) Regulierte Produktivitätssprünge: Mensch‑in‑the‑Loop bleibt Pflicht; Audit‑Pipelines und Compliance‑Gate senken Schadenrisiken. Trigger: gesetzliche Vorgaben (EU AI Act‑Umsetzung) und standardisierte Audit‑Reports. 2) Agenten‑Plattformdominanz: wenige Clouds bündeln Tooling, Daten und Zahlungsströme; Trigger: breite Kunden‑Referenzen und Marketplace‑Umsätze. 3) Sicherheits‑Bremsung: prominente Incidents oder Compliance‑Fälle führen zu Nutzungsbeschränkungen; Trigger: regulatorische Stop‑Orders oder große Haftungsurteile. Forschung zeigt, dass Infrastruktur‑Kosten, exklusive Daten und Talent die Pfade bestimmen (arXiv, 2025-06-16). Limitation: Granulare, verifizierte Zahlen zu Umsatzanteilen für “Agentic AI” fehlen. Kosten‑ und Energieargumente erfordern firmenspezifische FinOps‑Daten, die oft nicht öffentlich sind. Weiter zum Kapitel: Folgen, Gegenbeweise und harte Prüfsteine für die ZukunftFolgen, Gegenbeweise und harte Prüfsteine für die Zukunft

Agentic AI verändert Arbeit, Entscheidungsfreiheit und Umweltbilanzen — aber die harte Evidenz bleibt fragmentiert. Messbare Folgen zeigen sich in veränderten Jobprofilen, erhöhtem Monitoring‑Aufwand und neuen Haftungsfragen.Benchmarks wie SWE‑bench und Evaluations von Devin liefern erste Metriken, doch systematische Felddaten fehlen(AIwire, 2025-03-28).

1) Konkrete Folgen und ethische Konflikte

Jobs: Coding‑Agenten reduzieren Routineaufwand, verschieben Aufgabenprofile in Richtung Review und Integration. Letzte empirische Fallstudien stammen aus Branchenberichten; belastbare, sektorübergreifende Beschäftigungszahlen fehlen (Sramana Mitra, 2025-03-14). Nutzer‑Entscheidungsfreiheit: Agenten können Optionen automatisiert priorisieren. Das schafft Risiko unterschwelliger Manipulation und erfordert informierte Einwilligung und Audit‑Logs als Gegensteuer. Regionale Ungleichheit & Umwelt: Keine belastbaren, veröffentlichten Zahlen zu CO2‑Bilanz pro Produktions‑API‑Call für Agenten liegen vor; Energie‑ und FinOps‑Daten sind oft proprietär. Deshalb ist jeder Klima‑Claim aktuell spekulativ, sofern nicht durch Anbieter‑Metriken belegt.2) Stärkste Gegenpositionen & prüfbare Tests

Gegenpositionen: Autonomie wird überschätzt; Mensch‑in‑the‑Loop bleibt nötig; LLM‑Planung limitiert bei langfristiger Robustheit. Präzise Tests: prospektive RCTs in Back‑Office‑Workflows mit vordefinierten Fehler‑KPIs; Red‑Team‑Protokolle gegen Prompt Injection; Langzeit‑A/B‑Tests zur Produktivitätsbilanz. Erste Instrumente und Benchmarks (SWE‑bench, WebArena) ermöglichen solche Tests, sind aber noch nicht flächendeckend eingesetzt (AIwire, 2025-03-28).3) Harte Zukunftsindikatoren (5–7 Kennzahlen)

- Rate schwerwiegender Fehlentscheidungen pro 1 Mio. Aktionen (Audit‑Logs erforderlich).

- Netto‑Gewinn/Verlust durch Automatisierung je Arbeitsbereich (12‑Monats‑ROI‑Reporting).

- Anteil auditiert‑zertifizierter Agenten am Gesamtmarkt.

- Konzentrationsquote der Trainingsdaten (Top‑10‑Datenquellen in %).

- MTBF (Mean Time Between Failures) langer Agent‑Ketten.

- Energieverbrauch pro erfolgreich abgeschlossener Aufgabe (kWh/Task) mit Quellenangabe.

Fazit

Agentische KI markiert einen echten Architekturwechsel – aber noch keinen Freifahrtschein zur Autonomie. Die stärksten Fortschritte zeigen sich dort, wo Planung, Tool‑Nutzung und Kontrolle präzise orchestriert und auditiert werden. Kurzfristig entscheidet die Qualität von Evaluationsumgebungen und Governance darüber, ob Pilotprojekte in den Regelbetrieb gehen. Mittelfristig werden Compute‑Kosten, verlässliche Benchmarks und Haftungsfragen die Spreu vom Weizen trennen. Für Unternehmen heißt das: Schrittweise Deployments mit klaren KPIs, Red‑Team‑Protokollen und Mensch‑in‑the‑Loop. Für Politik und Standardisierung: Fokus auf Prüfverfahren, Offenlegungspflichten und Vorfallmeldungen. Worauf es jetzt ankommt, sind nachprüfbare Ergebnisse statt Versprechen – und Metriken, die falschliegen dürfen, damit wir rechtzeitig Kurs korrigieren können.Welche Metriken würden Sie für Agenten im Produktivbetrieb anlegen? Diskutieren Sie mit und teilen Sie konkrete Erfahrungen aus Ihren Teams.

Schreibe einen Kommentar