Inhaltsübersicht

Einleitung

Private Processing entschlüsselt: Was steckt hinter Metas KI-Analyse für Chats?

Harter Vergleich: Server-KI vs. On-Device-Lösungen und klassische Verschlüsselung

Risiken und Kontrolldefizite: Wo endet der Datenschutz wirklich?

Fazit

Einleitung

WhatsApp bekommt mit KI-gestützten Chat-Zusammenfassungen einen Hauch von Zukunft – und mit Metas „Private Processing“ eine Technik, die Privatsphäre und Komfort verspricht. Doch sobald private Chats Servern anvertraut werden, sind technikaffine Nutzer zu Recht skeptisch: Wer hat Zugriff? Wie funktioniert der Schutz wirklich? Während Meta Transparenz und Sicherheit betont, bleibt ein mulmiges Gefühl – denn was sich technisch raffiniert anhört, ist in der Praxis ein dichter Balanceakt zwischen unmittelbarem Nutzen und noch ungeklärten Risiken. In diesem Artikel legen wir die Architektur offen, vergleichen Ansätze großer Player und fragen: Ist „Private Processing“ ein echter Fortschritt für den Datenschutz – oder nur der nächste Kompromiss beim Schutz sensibler Kommunikation?

Private Processing entschlüsselt: Was steckt hinter Metas KI-Analyse für Chats?

So funktioniert „Private Processing“ im Detail

Meta versucht mit Private Processing einen Spagat: Nutzer sollen von KI-gestützten Funktionen wie der WhatsApp Zusammenfassung profitieren, während die sensiblen Chatdaten maximal geschützt bleiben. Technisch läuft die Chat-Analyse in speziell isolierten Rechenräumen ab, sogenannten Trusted Execution Environments (TEE). Das sind abgetrennte Bereiche auf spezialisierten Servern, die weder Meta noch Dritte von außen einsehen oder manipulieren können – zumindest in der Theorie.

Bevor Daten die Benutzergeräte verlassen, werden sie per HPKE (High-Performance Key Establishment) und Oblivious HTTP verschlüsselt und erst danach an die TEE übermittelt.

Der eigentliche KI-Prozess läuft in dieser Mini-Festung ab. Der Trick: Die Umgebung bleibt „stateless“ – sie vergisst alles nach der Analyse. Keine Chat-Historie, keine Rückstände.

Das Resultat der KI wird verschlüsselt an den Nutzer zurückgeschickt. Meta selbst sieht rein technisch weder die Rohdaten noch die Zusammenfassung.

Sicherheitsmechanismen, aber auch offene Fragen

TEEs haben ein Fail-Closed-Design: Bei jedem Fehler blockiert das System, um Datenabfluss auszuschließen. Über veröffentlichte Sicherheitsberichte will Meta zudem externe Auditierbarkeit erlauben – Neugierige können nachprüfen, wie die Architektur abgesichert ist. Dennoch gilt: Wer KI-Server nutzt, muss der Infrastruktur (und deren Updates) vertrauen. Angriffsvektoren wie Supply-Chain-Angriffe auf die Serverbasis oder Schwachstellen im Code können trotz größter Cybersicherheit Risiken bedeuten. Letztlich bleibt: Nutzer gewinnen Komfort durch Server-KI – sichern aber ihre Nutzerdaten nur, solange die Technik hält, was sie verspricht.

Harter Vergleich: Server-KI vs. On-Device-Lösungen und klassische Verschlüsselung

Server-KI mit “Private Processing”: Kontrollierter Fortschritt?

Meta setzt bei der WhatsApp Zusammenfassung auf Private Processing– ein serverbasiertes Modell, das mit sogenannten Trusted Execution Environments (kurz: TEE) für Sicherheitsgarantien sorgt. Konkret bedeutet das: Chats werden verschlüsselt an eine abgeschottete Rechenumgebung geschickt, dort von Künstlicher Intelligenz verarbeitet und das Ergebnis gelangt ebenso verschlüsselt zurück. Der Trick: Weder Meta noch Dritte sehen die Rohdaten. Das stateless Processing – also Verarbeiten ohne jegliches Speichern – soll Restzweifel ausräumen. Veröffentliche Architekturdaten und ein Fail-Closed-Design stärken das Vertrauen aus technischer Sicht.

On-Device-Verarbeitung: Apple im Fokus

Mit dem Prinzip Apple Private Cloud Compute setzt Apple auf vollständige Analyse direkt auf dem Gerät des Nutzers – ohne Auslagerung, ohne Datenabgriff. Dieses Konzept ist aus Datenschutzsicht maximal konsequent: Nur wer sein Smartphone verliert oder gehackt bekommt, verliert auch die Hoheit über die Daten. Die Schattenseite bleibt allerdings: KI-Modelle auf dem Gerät sind oft weniger leistungsfähig oder können nicht dieselbe Vielfalt bieten wie spezialisierte Server-KI.

Ende-zu-Ende-Verschlüsselung: Der “Signal”-Weg

Klassische Plattformen wie Signal betreiben überhaupt keine Chat-Analyse. Die Inhalte bleiben so privat, wie es aus Datenschutz-Sicht nur denkbar ist – KI bleibt außen vor. Aber: Auch innovative Funktionen wie eine WhatsApp Zusammenfassung bleiben damit unerreichbar.

Fazit: Konsequenzen für Kommunikationsplattformen

Wer starke KI-Features will, braucht komplexe Sicherheitsmechanismen und neue Balanceakte zwischen Funktionsvielfalt, Cybersicherheit und Nutzerdaten-Autonomie. Je mehr Server-KI ins Spiel kommt, desto mehr geraten Angriffsvektoren wie Supply-Chain-Angriffe oder TEE-Schwächen in den Fokus – eine Gratwanderung, die langfristig über Vertrauen und Erfolg von Messengern wie WhatsApp entscheiden könnte.

Risiken und Kontrolldefizite: Wo endet der Datenschutz wirklich?

Angriffsflächen im Fokus: Hinter den Kulissen von „Private Processing“

WhatsApp Zusammenfassungen mit Künstlicher Intelligenz klingen komfortabel, doch wie sicher ist das technische Rückgrat? Der Kern: Trusted Execution Environments (TEE). Sie versprechen, dass Nutzerdaten bei der Chat-Analyse verschlüsselt und isoliert verarbeitet werden. Doch absolute Immunität gibt es nicht. Wird eine TEE – etwa durch Zero-Day-Schwachstellen – kompromittiert, könnte der Schutz bröckeln. Der Gedanke ist unangenehm: Ein bislang unentdeckter Fehler, und plötzlich liegen sensible Nutzerdaten offen.

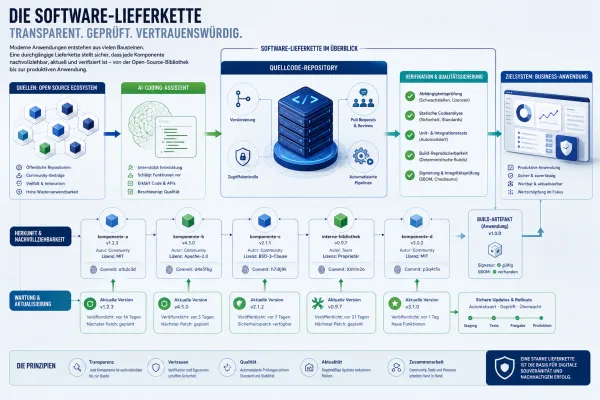

Supply-Chain-Angriffe und das Vertrauen in die Server-KI

Neben der direkten TEE-Bedrohung existieren Supply-Chain-Angriffe. Hier geraten Dritte ins Visier: Hardware- oder Softwarelieferanten, deren Komponenten im Server-KI-Prozess stecken. Schon eine fehlerhafte Library im System, und der streng regulierte „Private Processing“-Kokon ist durchlässig. Externe Sicherheitsmechanismen und regelmäßige Audits schaffen zwar Transparenz, ersetzen aber keine absolute Sicherheit – das Restrisiko bleibt.

Nutzersouveränität: Kontrolle oder Komfort?

So rosig die Versprechen von Meta klingen: Die Hoheit über persönliche Daten gerät in ein Spannungsfeld. Die unmittelbare Verarbeitung nach dem Stateless-Prinzip wirkt beruhigend. Doch die Nutzer haben keine vollständige Kontrolle darüber, was genau im Hintergrund mit ihren Chats passiert. Im Gegensatz zu Apples Private Cloud Compute oder klassischer Ende-zu-Ende-Verschlüsselung setzen sie auf ein System, in dem für Komfort und Innovation mit Autonomie und dem eigenen Gefühl von Datenschutz jongliert wird. Gelebter Fortschritt – mit einem Fragezeichen.

Fazit

Metas „Private Processing“ steht prototypisch für den Spagat zwischen smarter KI-Funktion und kompromisslosem Datenschutz. Während die technische Umsetzung neue Maßstäbe bei Transparenz und Sicherheit setzen kann, bleiben Unsicherheiten: Serverbasierte Verarbeitung, auch verschlüsselt und geprüft, bedeutet stets einen Vertrauensvorschuss. Nutzer müssen sich fragen, ob sie diesen Weg mitgehen oder auf lokale Lösungen setzen wollen. Für die digitale Gesellschaft ist klar: Wie wir KI in persönlichen Kommunikationsdiensten nutzen, wird grundlegend beeinflussen, wie viel Kontrolle wir künftig abgeben oder behalten.

Wie sehen Sie das neue WhatsApp-Feature – Risiko oder Fortschritt? Diskutieren Sie mit uns in den Kommentaren!

Quellen

Building Private Processing for AI tools on WhatsApp

WhatsApp unveils ‘Private Processing’ for cloud-based AI features

WhatsApp Rolls Out ‘Private Processing’ for AI Chats

WhatsApp launches ‘Private Processing’ to enhance AI chat privacy

Meta enhances WhatsApp with new upcoming AI feature updates powered by secure Private Processing

WhatsApp’s AI tools will use a new “Private Processing” system designed to allow cloud access without letting Meta or anyone else see end-to-end encrypted chats

WhatsApp borrowing Apple’s Private Cloud Compute approach to AI privacy

WhatsApp Launches Private Processing to Enable AI with Confidential Computing

WhatsApp Private Processing: Meta’s AI Push Could Undermine Privacy

WhatsApp Introduces Private Processing for Secure AI Message Handling

Hinweis: Dieser Artikel wurde mit Unterstützung von KI erstellt.