KI-Agenten wirken oft wie einzelne schlaue Assistenten. In der Praxis entsteht ihr Nutzen aber dort, wo viele kleine Schritte sauber koordiniert werden: Anfrage verstehen, Kontext holen, Tool auswählen, Rechte prüfen, Ergebnis protokollieren, vielleicht einen Menschen um Freigabe bitten. Genau diese Orchestrierung wird zur eigentlichen Architekturfrage.

Warum Orchestrierung mehr ist als Automatisierung

Ein klassischer Workflow führt feste Schritte aus. Ein KI-Agent kann dagegen planen, Zwischenergebnisse bewerten und Tools flexibel nutzen. Das macht ihn mächtig, aber auch schwerer kontrollierbar. Wenn ein Agent Code ändern, Tickets lesen, Dateien durchsuchen oder externe Dienste ansprechen darf, reicht ein guter Modellprompt nicht mehr aus. Es braucht eine Umgebung, die Aktionen begrenzt, nachvollziehbar macht und im Zweifel stoppt.

OpenAIs Symphony-Ankündigung ist dafür ein aktueller Aufhänger: Beschrieben wird ein Orchestrator, der Codex-Aufgaben, Issues und Entwicklungsarbeit koordinieren soll. Der wichtige Evergreen-Punkt liegt nicht in einem einzelnen Produktnamen. Er liegt in der Frage, wie Unternehmen KI-Arbeit so organisieren, dass Modelle austauschbar bleiben und Tool-Nutzung nicht zur Blackbox wird.

Was KI-Orchestrierung eigentlich bedeutet

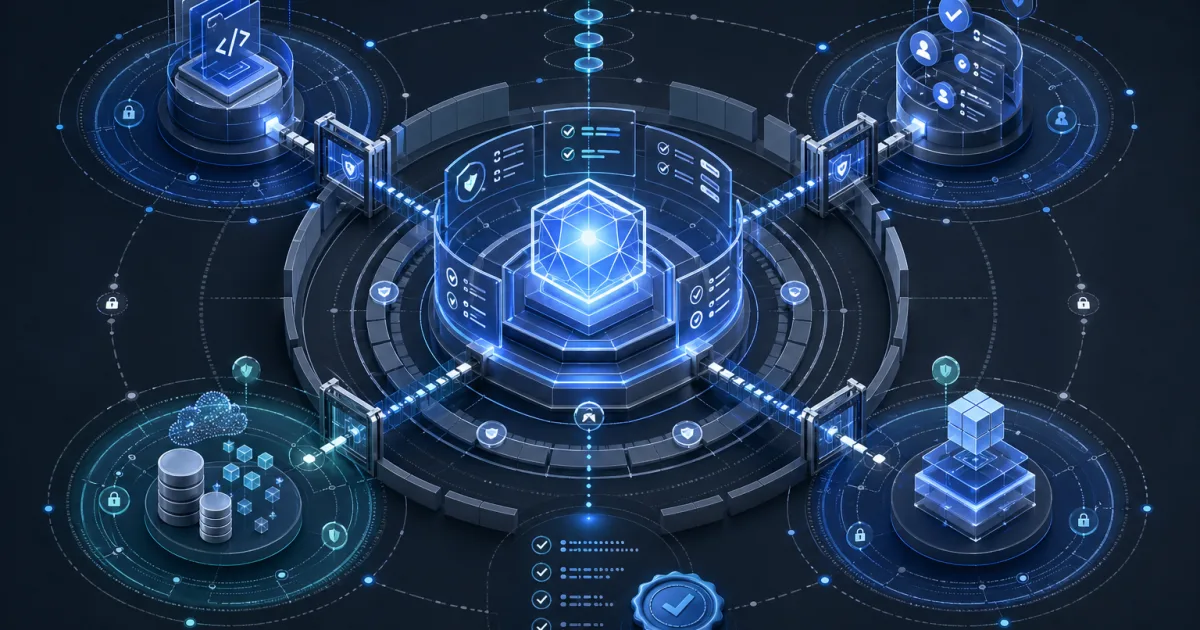

Orchestrierung ist die Steuerung mehrerer Komponenten in einem KI-Workflow. Dazu gehören das Modell, Systemanweisungen, Speicher, Such- und Kontextquellen, externe Werkzeuge, Berechtigungen, Policies, Logs, Evaluierungen und Übergaben an Menschen. Ein Orchestrator entscheidet nicht nur, welcher Schritt als nächstes kommt. Er setzt auch Grenzen: Welche Daten dürfen gelesen werden? Welche Aktion braucht Freigabe? Welche Ausgabe wird verworfen?

Der Unterschied zu einfachen Chatbots ist erheblich. Ein Chatbot beantwortet eine Frage. Ein orchestrierter Agent kann einen Plan erstellen, Dokumente abrufen, ein Skript ausführen, Pull Requests vorbereiten oder Supportfälle sortieren. Damit wandert KI vom Textfenster in operative Prozesse. Je näher sie an reale Systeme rückt, desto wichtiger werden Standards und Kontrollpunkte.

Warum offene Standards und Schnittstellen zählen

Offene Standards verhindern, dass ein Unternehmen seine gesamte Agentenarchitektur an einen Anbieter klebt. Wer Tool-Schnittstellen, Ereignisformate, Logs, Berechtigungen und Evaluierungsdaten proprietär hält, macht spätere Wechsel teuer. Das betrifft nicht nur das Modell. Auch Kontextspeicher, Ticket-Systeme, CI/CD-Pipelines, Dokumentenarchive und Freigabeprozesse müssen sauber angebunden werden.

Für Teams ist Austauschbarkeit kein akademisches Ideal. Modelle ändern Preise, Fähigkeiten, Sicherheitsprofile und Verfügbarkeit. Fachbereiche brauchen manchmal ein starkes Modell für Analyse, ein günstigeres Modell für Routineaufgaben und lokale Modelle für sensible Daten. Ohne standardisierte Orchestrierung wird aus jeder Anpassung ein Integrationsprojekt. Mit klaren Schnittstellen kann die Architektur stabil bleiben, während einzelne Komponenten wechseln.

Tool-Grenzen: Was ein Agent darf und was nicht

Die wichtigste Sicherheitsfrage lautet nicht: Ist das Modell freundlich? Sondern: Was darf es tun, wenn es sich irrt? Ein Agent mit Lesezugriff ist anders zu bewerten als ein Agent, der Dateien überschreibt, Produktionssysteme anspricht oder Kundendaten exportieren kann. Deshalb sollten Tools nicht pauschal freigeschaltet werden, sondern mit Rollen, Scopes, Zeitfenstern und Genehmigungen arbeiten.

Gute Orchestrierung trennt Lesen, Vorschlagen und Ausführen. Ein Agent kann beispielsweise Code analysieren und einen Patch vorbereiten, aber der Merge bleibt an Review-Regeln gebunden. Er kann eine Datenabfrage formulieren, aber keine sensiblen Tabellen ohne zusätzliche Freigabe lesen. Diese Trennung klingt bürokratisch, ist aber der Punkt, an dem KI-Produktivität und Risikomanagement zusammenkommen.

Logs, Nachvollziehbarkeit und menschliche Freigaben

Wenn KI-Agenten Entscheidungen vorbereiten, müssen Teams später verstehen können, was passiert ist. Welche Quellen wurden genutzt? Welcher Prompt oder welche Policy war aktiv? Welches Tool wurde mit welchen Parametern aufgerufen? Welche Ausgabe wurde verworfen? Ohne solche Spuren lassen sich Fehler kaum reproduzieren und Verantwortlichkeiten bleiben unklar.

Das NIST AI Risk Management Framework betont, dass KI-Risiken gemessen, gemanagt und in Governance-Prozesse eingebettet werden müssen. Für Agenten heißt das praktisch: Logs dürfen nicht nur technische Debug-Dateien sein. Sie sind Audit-Material. Ebenso wichtig sind definierte Human-in-the-Loop-Punkte. Nicht jede Kleinigkeit braucht Freigabe, aber irreversible oder externe Aktionen sollten bewusst durch eine menschliche Schwelle gehen.

Prompt Injection und Kontextvergiftung

Ein besonderes Risiko entsteht, wenn Agenten fremde Inhalte lesen. Ein Dokument, eine Webseite oder ein Ticket kann Anweisungen enthalten, die nicht als Daten, sondern als Befehl missverstanden werden. Prompt Injection ist deshalb kein exotisches Chatbot-Problem, sondern eine Orchestrierungsfrage: Der Orchestrator muss zwischen Systemregeln, Nutzerauftrag, Tool-Ausgabe und untrusted content unterscheiden.

Technisch helfen Sandboxen, Policy-Engines, Kontextklassifizierung, Quellenmarkierung und begrenzte Tool-Rechte. Organisatorisch hilft eine nüchterne Annahme: Jeder externe Inhalt kann manipuliert sein. Ein Agent darf aus solchen Inhalten Informationen ziehen, aber er sollte daraus nicht automatisch neue Rechte, Zieländerungen oder geheime Datenfreigaben ableiten.

Was Unternehmen beim Aufbau prüfen sollten

Ein sinnvoller Einstieg beginnt mit einem Inventar. Welche Agenten oder KI-Workflows gibt es bereits? Welche Tools nutzen sie? Welche Datenklassen berühren sie? Welche Aktionen sind reversibel, welche nicht? Danach lassen sich Policies definieren: Nur lesen, Entwurf erstellen, mit Freigabe ausführen oder vollständig automatisieren. Diese Stufen sind wichtiger als die Frage, ob ein Workflow „KI“ oder „Automation“ genannt wird.

Zweitens braucht es technische Mindeststandards: zentrale Identitäten statt geteilter API-Schlüssel, getrennte Rollen, Secret-Management, nachvollziehbare Tool-Aufrufe, Rate Limits, Ausführungsumgebungen und Tests. Drittens sollten Teams Evaluierungen nicht nur für Modellantworten bauen, sondern für ganze Abläufe. Ein Agent ist nur so sicher wie die Kombination aus Modell, Daten, Tool und Freigabepfad.

Warum das dauerhaft relevant ist

Die Agentenwelle wird nicht an einem einzelnen Modell hängen. Sie wird sich in Entwicklungsumgebungen, Office-Tools, CRM-Systemen, Datenplattformen, Supportprozessen und internen Workflows ausbreiten. Je mehr solche Systeme miteinander sprechen, desto wichtiger wird eine gemeinsame Sprache für Rechte, Ereignisse, Herkunft, Ausführung und Verantwortung.

Offene Orchestrierung ist deshalb ein Produktivitäts- und ein Sicherheitsfaktor. Sie hilft, KI schneller einzusetzen, ohne jede Integration neu zu erfinden. Gleichzeitig verhindert sie, dass Organisationen blind einem Modell oder einer Plattform vertrauen müssen. Der entscheidende Fortschritt liegt nicht darin, Agenten „autonomer“ wirken zu lassen, sondern sie verlässlicher, austauschbarer und prüfbarer zu machen.

Praktisch bedeutet das auch: Orchestrierung sollte früh als Produktentscheidung behandelt werden, nicht erst als Sicherheitsnachtrag. Wer nur einzelne Agenten testet, übersieht oft die dauerhafte Betriebsfrage: Wie werden neue Tools freigegeben, alte Berechtigungen entzogen, Modellwechsel dokumentiert und fehlerhafte Aktionen zurückgerollt? Genau an dieser Stelle werden offene Schnittstellen, verständliche Policy-Regeln und wiederholbare Tests zum Vorteil. Sie machen aus experimentellen Agenten eine belastbare Arbeitsumgebung, die wachsen kann, ohne jedes Mal bei null anzufangen.

Fazit

KI-Orchestrierung ist die Schicht, in der aus Modellfähigkeiten echte Arbeitsprozesse werden. Dort entscheidet sich, ob Agenten nützliche Assistenten oder unkontrollierbare Automationsinseln sind. Offene Standards, klare Tool-Grenzen, Logs, Policies und menschliche Freigaben machen den Unterschied.

Der wichtigste Lerneffekt: Unternehmen sollten KI-Agenten nicht nur nach Modellqualität bewerten. Sie sollten fragen, wie gut die Orchestrierung funktioniert. Wer darf was tun? Was wird protokolliert? Welche Komponenten lassen sich austauschen? Und wo bleibt der Mensch bewusst Teil der Entscheidung?

Quellen und weiterführende Informationen

- OpenAI: Open-source Codex orchestration with Symphony

- NIST AI Risk Management Framework

- GitHub: GitHub Actions 2026 security roadmap

Hinweis: Für diesen Artikel wurden KI-gestützte Recherche- und Editierwerkzeuge verwendet. Der Inhalt wurde menschlich redaktionell geprüft. Stand: 30.04.2026.