OpenAI 2026 steht für einen spürbaren Wechsel von KI als Gesprächspartner hin zu KI, die kleine Aufgaben wirklich erledigt. Praktische KI im Alltag bedeutet dann nicht mehr nur bessere Texte, sondern auch Hilfe beim Suchen, Sortieren, Zusammenfassen und beim Arbeiten mit Dateien und Apps. Möglich wird das durch neue Schnittstellen, die KI gezielt Werkzeuge nutzen lassen, sowie durch Fortschritte bei Sprache und Multimodalität. Gleichzeitig wachsen die Anforderungen an Datenschutz, Transparenz und verlässliche Ergebnisse. Wer versteht, wie diese Systeme arbeiten, kann sie nüchtern einschätzen und sinnvoll einsetzen.

Einleitung

Viele Menschen kennen das Gefühl. Man schreibt einer KI eine Frage, bekommt eine freundliche Antwort, und trotzdem bleibt Arbeit übrig. Die Mail muss noch formuliert werden, die Fakten müssen geprüft werden, das Dokument liegt irgendwo in einem Ordner, und am Ende klickt man sich doch wieder durch Apps und Tabs.

Genau an dieser Stelle entsteht gerade ein neuer Fokus. KI soll nicht nur reden, sondern helfen, Dinge zu erledigen, die im Alltag Zeit kosten. Dazu gehören kleine, aber nervige Aufgaben wie das Zusammenfassen langer Texte, das Sortieren von Notizen, das Finden einer Info in mehreren PDFs oder das Vorbereiten eines Telefonats. Klingt unspektakulär, ist aber oft der Unterschied zwischen Spielerei und echter Entlastung.

Rund um OpenAI wird diese Richtung häufig als „Agenten“ oder als toolgestützte KI beschrieben. Damit ist gemeint, dass ein Modell nicht nur Text ausgibt, sondern bei Bedarf gezielt Werkzeuge nutzt, etwa eine Suche, einen Dateizugriff oder einen Rechenschritt. Für 2026 ist daran spannend, dass diese Bausteine in immer mehr Anwendungen auftauchen, auch außerhalb von Entwicklerkreisen.

Vom Chat zur Handlung: Was „praktische KI“ heute meint

Ein Sprachmodell, oft als LLM abgekürzt, ist ein System, das aus sehr vielen Beispielen gelernt hat, wie Sprache typischerweise aufgebaut ist. Es kann Texte fortsetzen, Fragen beantworten oder Inhalte umformulieren. Das ist nützlich, löst aber nicht automatisch Alltagsprobleme, bei denen Informationen verteilt sind und mehrere Schritte nötig sind.

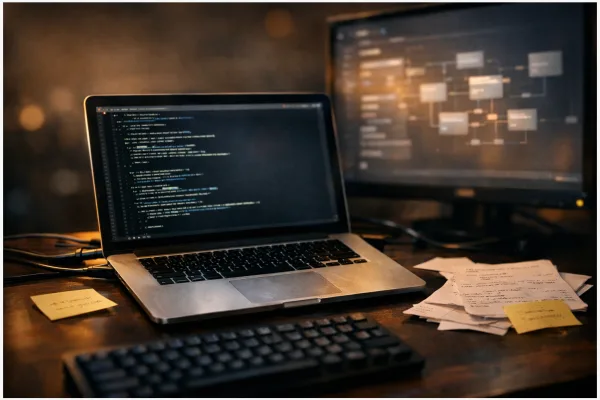

Praktische KI beginnt dort, wo das Modell in eine Art Arbeitsablauf eingebettet wird. Statt nur zu antworten, kann es Zwischenschritte machen, etwa eine Datei durchsuchen, eine Liste strukturieren oder eine Berechnung ausführen. OpenAI hat dafür 2025 eine neue Schnittstelle beschrieben, die sogenannte Responses API. Sie ist so gedacht, dass KI in mehreren Schritten arbeiten kann und dabei auch integrierte Werkzeuge ansteuert, zum Beispiel Websuche, Dateisuche oder eine Rechenumgebung.

Der wichtige Unterschied ist nicht, dass die KI „schlauer“ klingt, sondern dass sie im richtigen Moment etwas Konkretes tun darf und ihre Ergebnisse besser nachvollziehbar in Schritte zerlegt.

Warum wirkt das gerade jetzt greifbarer. Weil sich die Nutzung verschiebt. Der Stanford AI Index Report 2024 berichtet, dass 2023 in einer zitierten Erhebung rund 55 % der Organisationen KI in mindestens einer Funktion eingesetzt haben. Gleichzeitig wurden 2023 Investitionen in generative KI in der Größenordnung von rund 25 Mrd. US-Dollar ausgewiesen. Solche Trends bedeuten nicht, dass jede KI schon zuverlässig handelt. Sie zeigen aber, dass der Übergang vom Experiment zum Werkzeug in vielen Bereichen begonnen hat.

Für Nicht-Experten hilft ein einfaches Bild. Ein Chatbot ist wie eine Auskunft am Schalter, die dir etwas erklärt. Eine toolgestützte KI ist eher wie eine Assistenz, die auch Zugriff auf Unterlagen hat und dir eine Vorarbeit abnimmt. Ein „Agent“ ist die Variante, die Aufgaben in mehreren Schritten plant und dabei selbst entscheidet, welches Werkzeug sie als Nächstes braucht.

Wenn Zahlen oder Vergleiche in strukturierter Form klarer sind, kann hier eine Tabelle verwendet werden.

| Merkmal | Beschreibung | Wert |

|---|---|---|

| Chatantwort | Formuliert Text, ohne etwas außerhalb des Chats zu prüfen | Gut für Erklären und Entwürfe |

| Toolgestützte KI | Nutzt bei Bedarf Werkzeuge wie Suche oder Dateifunktionen | Gut für Recherche und Struktur |

| Agentischer Ablauf | Arbeitet in mehreren Schritten und sammelt Ergebnisse zusammen | Gut für wiederkehrende Aufgaben |

Warum praktische KI im Alltag plötzlich wirklich nützlich wird

Der Alltag besteht selten aus einer einzelnen Frage. Häufig geht es um Dinge wie „Ich muss das verstehen, entscheiden und dann etwas schreiben“. Genau dafür ist toolgestützte KI gemacht. Sie kann zum Beispiel erst die relevanten Stellen in mehreren Dokumenten finden, dann eine kurze Zusammenfassung liefern und am Ende einen Entwurf formulieren, der zu deinem Stil passt. Der Wert liegt weniger im letzten Satz, sondern im Weg dorthin.

Ein konkretes Szenario aus der Schule oder Ausbildung. Du hast ein langes PDF, dazu Notizen aus dem Unterricht und noch zwei Links mit Hintergrundinfos. Statt alles zu überfliegen, lässt du die KI die wichtigsten Punkte extrahieren und nach Themen sortieren. Danach stellst du Rückfragen. Was sind die Gegenargumente. Wo sind Unsicherheiten. Welche Begriffe muss ich nachschlagen. Diese Arbeitsweise ist oft realistischer als die Erwartung, eine einzige perfekte Antwort zu bekommen.

Im Job zeigt sich der Nutzen bei Routine. Ein Meetingprotokoll liegt als Text vor. Die KI kann Aufgaben herausziehen, sie zu Personen zuordnen und eine knappe Liste mit offenen Punkten schreiben. Oder sie hilft, aus einer langen Mailkette eine sachliche Zusammenfassung zu machen, die du prüfen und korrigieren kannst. Solche Funktionen entstehen nicht nur durch „mehr Intelligenz“, sondern durch bessere Einbindung in Software, also durch Schnittstellen, die Datei- und Toolzugriffe kontrolliert erlauben.

Besonders sichtbar wird das bei Sprache. OpenAI hat 2025 eine Realtime API vorgestellt, die für Sprachagenten in Echtzeit gedacht ist. Für den Alltag heißt das, dass gesprochene Interaktion nicht mehr wie ein Diktiergerät wirkt, sondern wie ein Dialog, der schneller reagiert. Das ist hilfreich beim Kochen, Autofahren oder beim schnellen Brainstorming, solange klar ist, dass die Inhalte überprüft werden müssen und nicht automatisch „wahr“ sind.

Viele dieser Funktionen werden nicht als einzelne App erlebt, sondern als Baustein in Diensten, die Menschen ohnehin nutzen. Im Idealfall ist die KI dann kein großes Ereignis, sondern ein leiser Helfer. Sie nimmt dir die erste Sortierung ab, macht Vorschläge und spart Klicks. Du bleibst aber die Person, die am Ende verantwortet, was rausgeht.

Wo es hakt: Fehler, Daten und neue Regeln

Je praktischer KI wird, desto sichtbarer werden auch ihre Grenzen. Sprachmodelle können überzeugend formulieren und trotzdem danebenliegen. Besonders heikel ist das bei Fakten, Zitaten oder Zahlen. Toolnutzung senkt dieses Risiko, weil ein Modell Quellen suchen oder Dokumente durchsuchen kann. Es verschwindet aber nicht, denn auch Suchergebnisse können falsch verstanden werden, und nicht jede Quelle ist zuverlässig.

Hinzu kommt ein typischer Alltagskonflikt. Damit eine KI wirklich hilft, braucht sie Kontext. Das sind Mails, Kalender, Dateien, eventuell auch Audio. Genau diese Daten sind aber sensibel. Deshalb wird in der Praxis viel davon abhängen, wie transparent Anbieter erklären, welche Daten verarbeitet werden, wie lange sie gespeichert werden und welche Optionen Nutzende haben. Wer KI in Schule oder Arbeit nutzt, muss außerdem klären, ob Inhalte vertraulich sind und ob sie überhaupt hochgeladen werden dürfen.

Für Unternehmen und Behörden kommt Regulierung als weiterer Rahmen dazu. Die EU hat den AI Act als Verordnung (EU) 2024/1689 verabschiedet. Nach Angaben der EU-Kommission trat er am 01.08.2024 in Kraft, und viele Pflichten werden überwiegend ab dem 02.08.2026 anwendbar. Der Kern ist ein risikobasierter Ansatz. Bestimmte Anwendungen gelten als besonders riskant und müssen strengere Anforderungen erfüllen, während viele Alltagsanwendungen weniger stark reguliert sind. Für Nutzer ist daran wichtig, dass Transparenzpflichten und Verantwortlichkeiten eher zunehmen werden.

Auch jenseits von Gesetzen gibt es Leitplanken. Das NIST AI Risk Management Framework 1.0, veröffentlicht am 26.01.2023, ist ein freiwilliges Rahmenwerk, das Organisationen hilft, KI-Risiken systematisch zu steuern. Es arbeitet mit vier Funktionen. Govern bedeutet klare Verantwortung. Map bedeutet den Einsatzkontext sauber zu beschreiben. Measure steht für Testen und Bewerten. Manage heißt, Risiken aktiv zu reduzieren und Vorfälle zu behandeln. Für den Alltag übersetzt sich das in eine einfache Haltung. Nicht blind vertrauen, sondern prüfen, begrenzen und dokumentieren, was ein System tun darf.

Blick nach vorn: Wie KI leiser, hilfreicher und normaler wird

Der spannendste Teil an OpenAI 2026 ist weniger ein einzelnes Modell, sondern die Richtung. Es geht um KI als Infrastruktur. Ähnlich wie Rechtschreibprüfung oder Kartenapps irgendwann selbstverständlich wurden, könnten auch KI-Funktionen in viele Oberflächen einziehen, ohne dass man sie jedes Mal als „KI“ wahrnimmt. Das passt zum Trend, dass Schnittstellen wie die Responses API darauf ausgelegt sind, mehrere Schritte, Werkzeuge und Datenquellen zu verbinden.

Damit dieser Alltag funktioniert, braucht es drei Eigenschaften. Erstens muss die Interaktion schneller werden, besonders bei Sprache. Zweitens müssen Ergebnisse besser begründbar sein, zum Beispiel durch klare Schritte, Quellenhinweise oder nachvollziehbare Zwischenergebnisse. Drittens müssen Grenzen sichtbar sein. Was kann das System sicher. Wo rät es nur. Wo fehlen Daten. Gerade das ist im Alltag wichtig, weil man sonst falsche Sicherheit bekommt.

Ein realistisches Szenario für die nächsten Jahre ist deshalb eine Art Mischform. Für einfache Aufgaben reicht eine schnelle, günstige KI, die Texte glättet oder Listen erstellt. Für heiklere Dinge, etwa rechtliche Formulierungen, Bewerbungsentscheidungen oder sicherheitsrelevante Prozesse, werden strengere Kontrollen, Dokumentation und menschliche Aufsicht wichtiger. Der EU AI Act ist in genau dieser Logik gebaut, und auch Rahmenwerke wie NIST setzen auf kontinuierliches Testen und klare Zuständigkeiten.

Für dich als Nutzer heißt das. Der größte Gewinn entsteht oft nicht durch die „perfekte Antwort“, sondern durch weniger Reibung. Gute Systeme helfen dir, Informationen zu ordnen, Optionen zu vergleichen und den eigenen Text sauber zu formulieren. Gleichzeitig bleibt eine gesunde Skepsis Teil der Kompetenz. Wer praktische KI im Alltag nutzt, sollte sich angewöhnen, bei wichtigen Aussagen eine Quelle zu verlangen, Zahlen zu prüfen und sensible Daten bewusst zu behandeln.

Fazit

OpenAI 2026 steht als Kurzform für einen Wandel, der sich schon jetzt abzeichnet. KI rückt weg vom reinen Chat und hin zu Werkzeugen, die in kleinen Schritten echte Arbeit abnehmen. Das gelingt vor allem dann, wenn Modelle gezielt suchen, Dateien auswerten oder in kontrollierten Umgebungen rechnen dürfen. Dadurch wird KI für Alltagssituationen interessanter, in denen es um Sortieren, Vorbereiten und Verdichten geht.

Gleichzeitig steigt die Verantwortung. Je mehr Kontext ein System bekommt, desto wichtiger werden Datenschutz, klare Regeln und verlässliche Tests. Regulierung wie der EU AI Act und Rahmenwerke wie das NIST AI RMF zeigen, wohin die Reise geht. Transparenz und Risikomanagement werden nicht nur „nice to have“ sein, sondern Teil der Normalität.

Am Ende entscheidet weniger die Technik auf dem Papier, sondern wie sie sich in echte Abläufe einfügt. Praktische KI im Alltag fühlt sich dann nicht wie Science-Fiction an, sondern wie ein gut gemachtes Werkzeug, das Zeit spart, ohne dein Denken zu ersetzen.

Wie nutzt du KI heute schon ganz praktisch, und wo wäre dir ein bisschen weniger KI und ein bisschen mehr Verlässlichkeit lieber. Teile den Artikel gern, wenn er dir beim Einordnen geholfen hat.