Enterprise-KI wird nicht dadurch vertrauenswürdig, dass ein Modell besonders leistungsfähig ist. Sie wird erst dann produktiv nutzbar, wenn Unternehmen nachvollziehen können, wie ein Dienst betrieben wird: Wer darf zugreifen? Welche Ereignisse werden protokolliert? Wie werden Änderungen überwacht? Welche Daten dürfen überhaupt in das System? Genau deshalb rücken Sicherheitszertifizierungen und laufende Nachweise bei KI-Diensten in den Vordergrund.

OpenAIs Meldung, dass ChatGPT Enterprise und die API Platform im FedRAMP-Kontext verfügbar sind, ist dafür ein guter aktueller Signalpunkt. Der wichtigere Evergreen-Punkt liegt aber nicht bei einem einzelnen Anbieter. FedRAMP zeigt, wie sich Cloud-Sicherheit, Betriebskontrollen und Beschaffungsfähigkeit in regulierten Umgebungen formal nachweisen lassen. Für deutsche und europäische Leser ist das kein eins-zu-eins-Ersatz für EU AI Act, DSGVO oder interne Informationssicherheit. Es ist eher ein anschauliches Beispiel für die größere Frage: Welche Belege brauchen Organisationen, bevor sie KI-Dienste in sensiblen Prozessen einsetzen?

Was FedRAMP eigentlich beweisen soll

FedRAMP ist ein US-Programm für die Sicherheitsbewertung, Autorisierung und kontinuierliche Überwachung von Cloud-Diensten, die von Bundesbehörden genutzt werden. Der Grundgedanke ist einfach: Eine Behörde soll sich nicht allein auf Marketingaussagen eines Cloud-Anbieters verlassen müssen, sondern auf ein standardisiertes Paket aus Kontrollen, Prüfungen, Dokumentation und laufendem Monitoring zugreifen können.

Bei KI-Diensten verschiebt sich diese Logik in ein besonders wichtiges Feld. Ein klassischer SaaS-Dienst verarbeitet Daten, steuert Zugriffe und speichert Protokolle. Ein Enterprise-KI-Dienst tut das ebenfalls, aber zusätzlich kommen Modellverhalten, Prompt- und Kontextdaten, Retrieval-Systeme, Toolzugriffe, Integrationen und potenziell automatisierte Aktionen hinzu. Die Nachweisfrage wird dadurch breiter: Nicht nur die Cloud-Plattform muss belastbar sein, sondern auch die Art, wie KI-Funktionen in diese Plattform eingebettet, kontrolliert und beobachtet werden.

Warum Zertifizierungen bei Enterprise-KI wichtiger werden

In vielen Unternehmen ist KI längst aus der Experimentierphase herausgewachsen. Teams wollen Assistenten in Dokumenten, Ticketsystemen, Kundenservice, Entwicklung, Analyse und internen Workflows einsetzen. Je näher KI an echte Geschäftsprozesse rückt, desto weniger reicht die Frage „Kann das Modell die Aufgabe lösen?“. Die bessere Frage lautet: Kann die Organisation den Dienst sicher betreiben, prüfen und im Zweifel begrenzen?

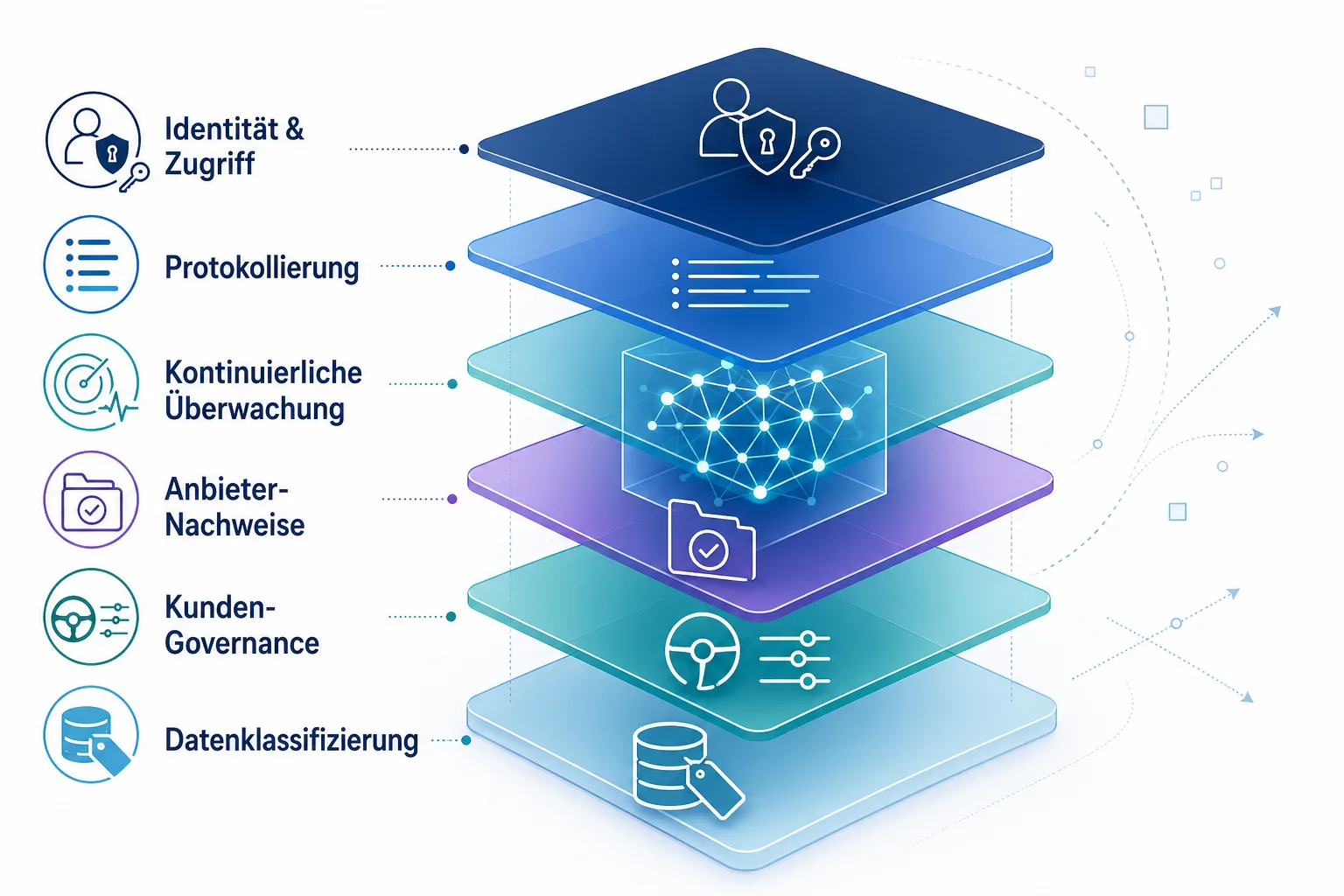

Zertifizierungen helfen vor allem dort, wo Einkauf, IT-Sicherheit, Datenschutz und Fachbereiche dieselbe Sprache brauchen. Sie übersetzen technische Kontrollen in prüfbare Kategorien: Identitäts- und Zugriffsmanagement, Verschlüsselung, Schwachstellenmanagement, Änderungsprozesse, Incident Response, Logging, Lieferkette und kontinuierliche Überwachung. Das ist trocken, aber entscheidend. Ohne solche Nachweise bleibt Enterprise-KI oft in Pilotprojekten hängen, weil niemand Verantwortung für den Regelbetrieb übernehmen will.

Was solche Nachweise nicht leisten

Eine Zertifizierung ist kein Sicherheitssiegel im Sinne von „ab jetzt ist alles ungefährlich“. Sie sagt nicht, dass ein Unternehmen den Dienst automatisch richtig konfiguriert. Sie garantiert nicht, dass Mitarbeitende keine sensiblen Daten eingeben. Sie verhindert keine schlechten Berechtigungsmodelle, keine überbreiten Datenfreigaben und keine fachlich falschen Entscheidungen durch Menschen, die KI-Ausgaben ungeprüft übernehmen.

Gerade bei KI ist diese Grenze wichtig. Anbieter können viel über Infrastruktur, Betriebsprozesse und Plattformkontrollen belegen. Die konkrete Nutzung entsteht aber beim Kunden: Welche Datenquellen werden angebunden? Welche Rollen dürfen welche Informationen abrufen? Werden Prompts, Antworten und Toolaktionen revisionssicher protokolliert? Gibt es Freigabeprozesse für besonders kritische Anwendungsfälle? Werden Modellrisiken regelmäßig bewertet? Diese Fragen lassen sich nicht an eine Anbieterzertifizierung auslagern.

FedRAMP, NIST AI RMF und EU AI Act: ähnliche Nachweisfrage, anderer Zweck

FedRAMP, das NIST AI Risk Management Framework und der EU AI Act sollten nicht in einen Topf geworfen werden. FedRAMP adressiert Cloud-Sicherheitsautorisierung im US-Behördenkontext. Das NIST AI RMF liefert einen Rahmen, um KI-Risiken zu identifizieren, zu messen, zu steuern und zu überwachen. Der EU AI Act regelt KI-Systeme nach Risikoklassen und Pflichten im europäischen Markt. Trotzdem treffen sich alle drei bei einem praktischen Punkt: Vertrauen braucht Belege.

Für europäische Unternehmen ist FedRAMP deshalb interessant, ohne unmittelbar maßgeblich zu sein. Wer KI-Dienste beschafft, kann aus der FedRAMP-Logik lernen, welche Fragen in Anbieterprüfungen gehören: Welche Kontrollnachweise gibt es? Sind sie aktuell? Welche Teile des Dienstes sind abgedeckt? Welche Subprozessoren und Cloud-Komponenten sind beteiligt? Wie wird kontinuierlich überwacht? Und wo beginnt die Verantwortung des Kunden?

Die wichtigsten Prüffragen für Unternehmen

Ein brauchbarer Beschaffungs- und Freigabeprozess für Enterprise-KI sollte nicht beim Modellnamen stehen bleiben. Er sollte mindestens fünf Bereiche abdecken. Erstens: Datenklassifizierung. Unternehmen müssen wissen, welche Daten in welchen KI-Dienst dürfen und welche kategorisch ausgeschlossen bleiben. Zweitens: Zugriffsschutz. Rollen, Gruppen, Mandantenfähigkeit und temporäre Freigaben sind wichtiger als eine hübsche Chat-Oberfläche.

Drittens: Nachvollziehbarkeit. Wer hat welche Daten genutzt, welche Antwort erzeugt, welche Aktion angestoßen? Viertens: Betriebs- und Lieferkettennachweise. Dazu gehören Schwachstellenmanagement, Drittanbieter, Infrastrukturregionen, Backup- und Incident-Prozesse. Fünftens: Risiko-Governance. KI-Dienste verändern sich, Modelle werden aktualisiert, Funktionen kommen hinzu. Eine einmalige Freigabe reicht nicht, wenn der Dienst selbst dynamisch bleibt.

Warum das dauerhaft relevant ist

Enterprise-KI wird in den kommenden Jahren weniger über einzelne Chatbots definiert, sondern über eingebettete Funktionen in Arbeitsplattformen, Fachanwendungen und Automatisierungsketten. Je unsichtbarer KI im Alltag wird, desto wichtiger werden überprüfbare Leitplanken. Unternehmen werden KI-Dienste nicht nur nach Antwortqualität vergleichen, sondern nach Auditierbarkeit, Integrationssicherheit, Datenkontrolle und regulatorischer Anschlussfähigkeit.

Das verändert auch die Rolle von IT-Sicherheit und Datenschutz. Sie sind nicht mehr nur die Instanz, die KI-Nutzung erlaubt oder blockiert. Sie müssen Kriterien entwickeln, mit denen produktive KI verantwortbar wird. Zertifizierungen wie FedRAMP können dabei helfen, weil sie Anbieter zu strukturierten Nachweisen zwingen. Sie sind aber nur ein Baustein. Die eigentliche Arbeit bleibt, diese Nachweise mit den eigenen Daten, Prozessen, Risiken und Verantwortlichkeiten zu verbinden.

Was Leser im Blick behalten sollten

Der wichtigste Satz lautet: Zertifizierung ist ein Startpunkt für Vertrauen, kein Ersatz für Governance. Wer KI-Dienste einführt, sollte Nachweise einfordern, aber ebenso kritisch prüfen, welche konkreten Funktionen, Datenflüsse und Regionen wirklich abgedeckt sind. Außerdem sollten Unternehmen die Sprache der Zertifikate in operative Regeln übersetzen: Datenklassen, Rollenmodelle, Freigaben, Protokolle, Review-Zyklen und klare Zuständigkeiten.

Für Anbieter wird dieser Nachweisdruck eher steigen. Für Kunden wird die Fähigkeit, solche Nachweise zu lesen, fast genauso wichtig wie die Fähigkeit, gute Prompts zu schreiben. Enterprise-KI ist nicht nur eine Produktivitätsfrage. Sie ist eine Betriebs-, Sicherheits- und Compliance-Frage — und genau dort entscheidet sich, ob aus Experimenten belastbare Infrastruktur wird.

Praktisch bedeutet das: Wer heute eine KI-Plattform auswählt, sollte nicht nur eine Funktionsliste vergleichen, sondern einen Nachweisordner erwarten. Darin gehören aktuelle Prüfberichte, klare Zuständigkeiten, nachvollziehbare Datenflüsse, dokumentierte Incident-Prozesse und eine Roadmap, wie neue KI-Funktionen sicher eingeführt werden.

Quellen

- OpenAI — OpenAI available at FedRAMP Moderate

- FedRAMP.gov — official program and marketplace

- NIST AI Risk Management Framework

- European Commission — EU AI Act regulatory framework

Hinweis: Für diesen Artikel wurden KI-gestützte Recherche- und Editierwerkzeuge verwendet. Der Inhalt wurde menschlich redaktionell geprüft. Stand: 29. April 2026.