AWS beschreibt den Betrieb von Claude Cowork und Claude Code Desktop über Amazon Bedrock und rückt damit KI-Agenten näher an die klassische Unternehmens-IT. In einem Beitrag vom 21. April 2026 erklärt AWS, wie Organisationen die Anthropic-Werkzeuge über Bedrock in bestehende Cloud-Umgebungen einbinden können. Für Unternehmen ist das relevant, weil agentische KI damit nicht nur als einzelner Chatbot, sondern als kontrollierbare Infrastrukturfrage behandelt wird.

Der Kern der Meldung ist bewusst nüchtern: AWS hat nicht einfach ein neues Endnutzerprodukt gestartet. Der Anbieter zeigt vielmehr, wie Claude Cowork und Claude Code Desktop über Amazon Bedrock betrieben werden können. Laut AWS sollen Firmen dadurch vorhandene Sicherheitsmechanismen, Zugriffsmodelle und Cloud-Prozesse nutzen können, statt KI-Agenten als isolierte Schatten-Tools einzuführen.

Warum der Bedrock-Weg für Firmen interessant ist

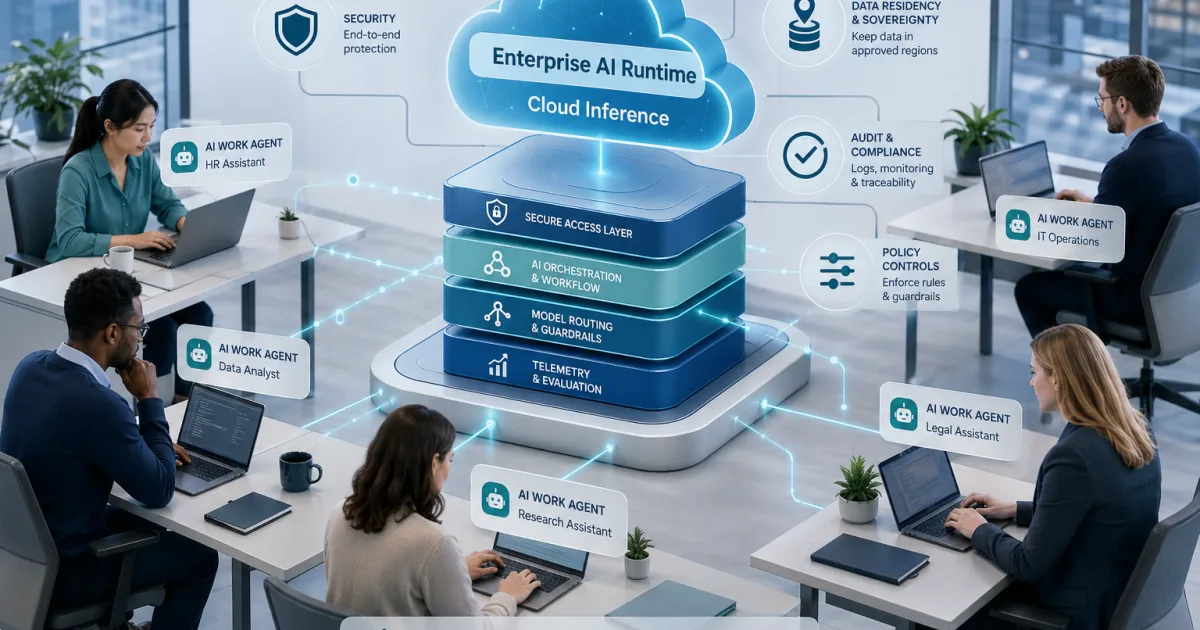

Claude Cowork ist von Anthropic als agentisches Arbeitswerkzeug gedacht: Es soll Aufgaben über mehrere Schritte hinweg bearbeiten und dabei mit Arbeitsumgebungen, Dateien oder Entwickler-Workflows zusammenspielen. Genau dieser Anspruch macht die Technik für IT-Abteilungen anspruchsvoll. Sobald ein Agent nicht nur Text formuliert, sondern Arbeit vorbereitet oder Aktionen in Tools anstößt, werden Identität, Protokollierung, Datenflüsse und Freigaben wichtiger als die reine Modellqualität.

AWS argumentiert deshalb mit dem vertrauten Enterprise-Vokabular: bestehende AWS-Umgebung, Skalierung, Sicherheitskontrollen und regionale Datenresidenz. Nach Darstellung von AWS speichert Amazon Bedrock Prompts, Dateien und Tool-Ausgaben nicht für das Training der Basismodelle. Solche Aussagen bleiben Herstellerangaben, sind für regulierte Organisationen aber genau die Punkte, an denen Pilotprojekte oft scheitern oder zumindest deutlich langsamer werden.

Anthropic öffnet Cowork für mehrere Inferenzanbieter

Die Einordnung wird durch Anthropic selbst gestützt. Im Help Center beschreibt das Unternehmen, dass Claude Cowork mit Drittplattformen wie Amazon Bedrock, Google Cloud Vertex AI, Azure AI Foundry und LLM-Gateways genutzt werden kann. Prompts und Antworten laufen in dieser Bereitstellungsform laut Anthropic über den jeweiligen Inferenzanbieter; Anthropic sieht diese Inhalte nach eigener Darstellung nicht. Das ist kein Freifahrtschein für Datenschutz, aber ein wichtiger Architekturhinweis.

Für größere Organisationen entsteht dadurch ein anderes Beschaffungsmodell. Statt jeden KI-Assistenten als eigenes SaaS-Produkt einzuführen, können sie Agenten stärker über vorhandene Cloud-Verträge, Sicherheitsprüfungen und Betriebsprozesse steuern. Das passt zu einem Markt, in dem Anbieter wie Microsoft, Google, OpenAI, ServiceNow und Adobe ebenfalls versuchen, Agenten aus der Demo-Ecke in verwaltete Unternehmensplattformen zu holen.

Produktivität trifft Governance

Der praktische Nutzen hängt allerdings nicht nur an der Bereitstellung. Ein Agent, der in Dateien liest, Code analysiert oder Arbeitsabläufe vorbereitet, braucht klare Grenzen: Welche Daten darf er sehen? Welche Systeme darf er ansprechen? Wann muss ein Mensch bestätigen? Wie werden Fehler nachvollzogen? Unternehmen, die diese Fragen auslassen, bekommen zwar schnell beeindruckende Demos, aber selten belastbare Produktivität.

Gerade deshalb ist der Bedrock-Ansatz interessant. Er verschiebt die Diskussion von „Welcher Chatbot ist am klügsten?“ zu „Wie betreiben wir KI-Agenten wie Unternehmenssoftware?“. Dazu gehören Rollenmodelle, Audit-Spuren, Kostenkontrolle, Modellwahl, Datenresidenz und Notfallprozesse. Der technische Unterbau ersetzt diese Governance nicht, kann sie aber realistischer machen.

Für Fachabteilungen ist das eine kleine, aber wichtige Verschiebung. Produktivität entsteht nicht dadurch, dass ein Agent alles darf, sondern dadurch, dass er genau die richtigen Aufgaben innerhalb sauber definierter Leitplanken übernehmen kann.

Was offen bleibt

Nüchtern betrachtet liefern AWS und Anthropic vor allem Produkt- und Architekturinformationen. Unabhängige Messwerte dazu, wie zuverlässig Claude Cowork in großen Organisationen arbeitet, liegen aus den genannten Quellen nicht vor. Auch konkrete Kosten, regionale Verfügbarkeit, Admin-Details und Compliance-Bewertungen müssen Unternehmen im Einzelfall prüfen. Wer daraus sofort eine garantierte Datensouveränität ableitet, würde die Quellen überdehnen.

Für TechZeitgeist-Leser ist die Meldung trotzdem mehr als ein B2B-Update. Sie zeigt, wohin sich digitale Produktivität gerade bewegt: KI-Agenten werden nicht nur leistungsfähiger, sondern stärker in die Infrastruktur verlagert. Der nächste Wettbewerb entscheidet sich daher nicht allein am Modell, sondern daran, wer Agenten sicher, nachvollziehbar und alltagstauglich in echte Arbeitsprozesse bringt.

Quellen

- AWS Machine Learning Blog: Running Claude Cowork in Amazon Bedrock

- Anthropic Help Center: Use Claude Cowork with third-party platforms

- Anthropic: Claude Cowork product page

Hinweis: Für diesen Artikel wurden KI-gestützte Recherche- und Editierwerkzeuge verwendet. Der Inhalt wurde menschlich redaktionell geprüft. Stand: 28. April 2026.