Versicherungen setzen heute verstärkt auf KI in Versicherungen, um Schadenmeldungen schneller zu bearbeiten und Fehlerquellen zu reduzieren. Dieser Text zeigt, welche Technologien dahinterstehen, wie sich Abläufe im Alltag ändern, welche Chancen sich daraus ergeben und welche Kontrollmechanismen nötig sind. Anhand aktueller Studien und Fallbeispiele wird klar, wo KI bereits Zeit und Kosten spart und wo Vorsicht und Transparenz wichtig bleiben.

Einleitung

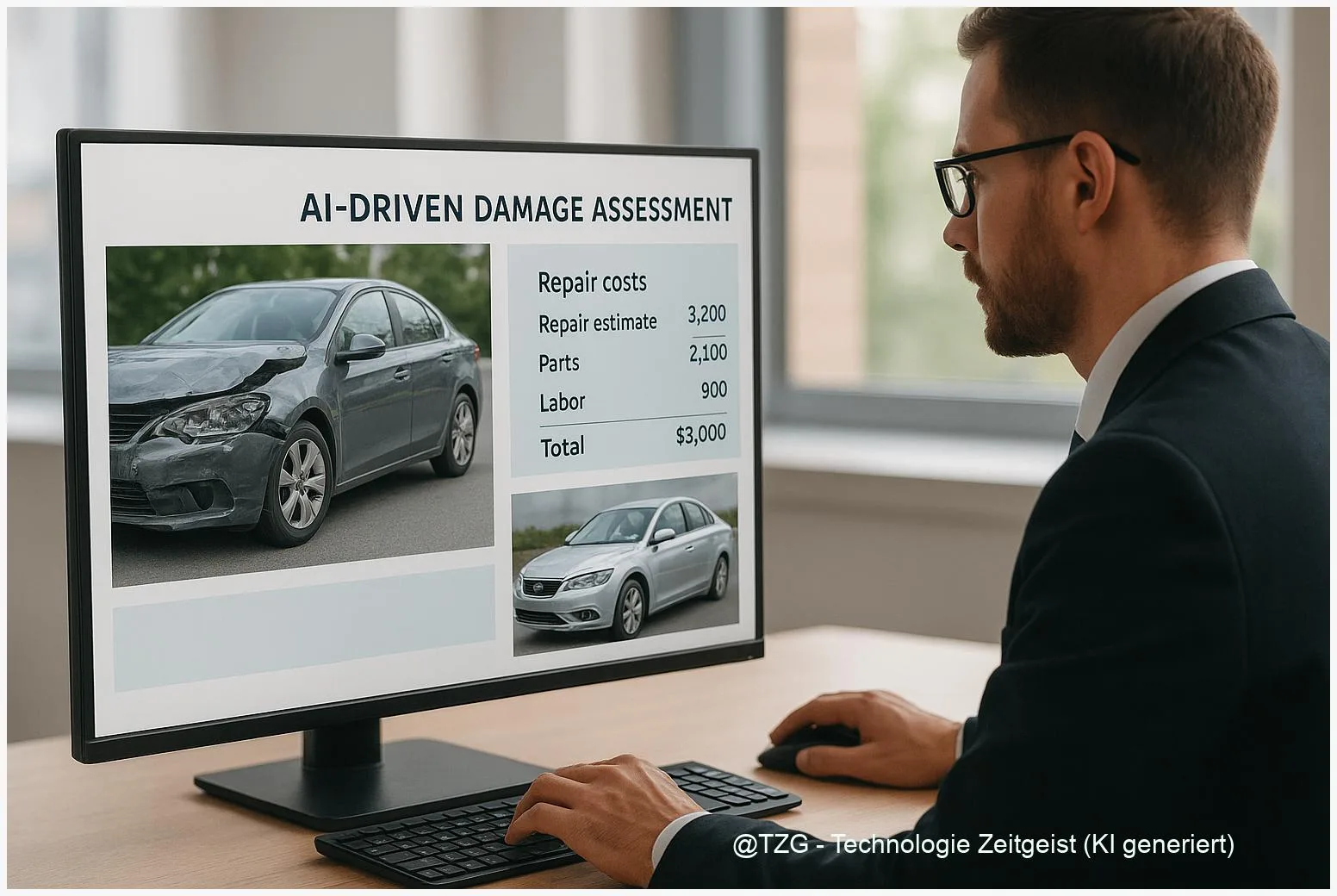

Viele Menschen erleben nach einem Schaden lange Wartezeiten, wiederholte Rückfragen und undurchsichtige Entscheidungen. Das kostet Zeit, Nerven und in manchen Fällen Geld. Versicherer versprechen seit einigen Jahren, Abläufe mit Hilfe von künstlicher Intelligenz zu beschleunigen: Fotos aus der App automatisch auswerten, erste Kostenschätzung sofort erstellen, offensichtliche Fälle ohne menschliches Zutun abwickeln. Für welche Fälle das zuverlässig funktioniert, wie viel davon bereits Realität ist und wo Regeln nötig sind, beschreibt dieser Beitrag.

Die folgenden Abschnitte erklären die wichtigsten Technologien, zeigen konkrete Beispiele aus der Praxis, diskutieren Chancen und Risiken und skizzieren mögliche Leitplanken für den verantwortungsvollen Einsatz. Ziel ist ein verständlicher Überblick, der im Jahr 2025 noch relevant bleibt.

KI in Versicherungen: Grundlagen und wie es funktioniert

Unter „KI“ in der Schadenbearbeitung versteht man heute meist Kombinationen aus Computer Vision (Bildauswertung), Natural Language Processing (Texterkennung) und regelbasierter Prozessautomatisierung. Ein neuronales Netz ist ein Rechenmodell, das aus vielen einfachen Rechenknoten besteht und Muster in Daten erkennt; hier hilft es, Schäden auf Fotos zu klassifizieren oder Textfelder in Schadensmeldungen automatisch auszulesen.

Ein zentrales Prozessstück heißt FNOL (First Notice of Loss) – die erste Meldung eines Schadens. KI kann hier Bilder automatisch analysieren, Schweregrade einschätzen und einen ersten Kostenvorschlag machen. In komplexen oder strittigen Fällen bleibt die menschliche Prüfung erhalten: das Konzept heißt “Human in the Loop” und sorgt dafür, dass kritische Entscheidungen nicht allein einer Black‑Box überlassen werden.

Geschwindigkeit allein reicht nicht: Nachvollziehbarkeit, Datenherkunft und Prüfschritte entscheiden, ob automatisierte Entscheidungen vertrauenswürdig sind.

Damit solche Systeme belastbar werden, brauchen Unternehmen nachvollziehbare Datenherkunft (Data‑Lineage), Tests gegen unabhängige Daten und Instrumente für Explainability — also Mechanismen, die erklären, warum ein Modell zu einer Einschätzung kam.

Wenn Zahlen helfen: Herstellerberichte dokumentieren für bestimmte Routinefälle Automatisierungsraten von rund 60–80 %; solche Aussagen stammen teilweise aus 2023 und sind damit älter als zwei Jahre. Sie zeigen das Potenzial, müssen aber mit unabhängiger Validierung ergänzt werden.

Wenn Vergleiche sinnvoll sind, hilft eine kurze Tabelle:

| Merkmal | Beschreibung | Wert |

|---|---|---|

| FNOL‑Automatisierung | Erste Schätzung basierend auf Bildern und Angaben | 60–80 % (je nach Prozess, Herstellerangaben) |

| Touchless‑Processing | Fallabschluss ohne menschliche Intervention | Bis zu >90 % in vereinzelten Fallstudien |

Wie KI Schadenbearbeitung im Alltag beschleunigt

In der Praxis sieht das so aus: Nach einer Kollision macht die versicherte Person mit dem Smartphone Fotos. Eine App analysiert die Bilder, erkennt beschädigte Bauteile und schätzt Reparaturkosten. Bei klaren Fällen wird direkt ein Kostenvoranschlag erstellt, ein Werkstatttermin vorgeschlagen oder eine Auszahlung angestoßen. Solche Abläufe reduzieren Rückfragen und verkürzen die Zeit bis zur ersten Entscheidung oft von Tagen auf Stunden oder Minuten.

Hersteller‑ und Fallstudien legen nahe, dass Foto‑basierte Systeme besonders bei standardisierten Schäden zuverlässig arbeiten. Beispiele aus Europa nennen Abwicklungszeiten “in Minuten statt Tagen” in Pilotprojekten; diese konkreten Angaben beruhen auf Firmenreports aus 2021–2023 und sind damit älter als zwei Jahre. Solche Fallbeispiele zeigen, wie viel Potenzial vorhanden ist, geben aber nicht automatisch Aufschluss über alle Regionen oder Schadenstypen.

Weitere Alltagsszenen: automatische Texterkennung in Schadenformularen, KI‑gestützte Vorselektion möglicher Betrugsfälle, automatische Übersetzung von Kundenangaben und die Kombination mit Telemetriedaten aus Fahrzeugen. In der Hausrat‑ und Wohngebäudeversicherung helfen Bilder von Wasserschäden, schnelle Entscheidungen zu Reparaturfreigaben zu treffen.

Wichtig ist, dass Geschwindigkeit nicht gleichbedeutend mit vollständiger Automatisierung ist. Viele Anbieter arbeiten mit abgestuften Workflows: einfache Fälle werden vollautomatisch abgearbeitet, bei Unsicherheiten greifen Review‑Queues und menschliche Expertinnen oder Experten ein. Das reduziert Fehler und erlaubt einen kontrollierten Ausbau der Automatisierung.

Chancen und Risiken: Geschwindigkeit gegen Kontrolle

Die Chancen sind konkret: schnellere Erledigung, geringere Betriebskosten, weniger Papierkram und oft eine bessere Kundenerfahrung. Versicherer können dadurch Kapazitäten frei machen, um komplexere Fälle intensiver zu betreuen. Gleichzeitig lassen sich Betrugsmuster früher entdecken, was Prämien stabilisieren kann.

Auf der anderen Seite entstehen Risiken, die Aufmerksamkeit verlangen. Trainingsdaten können verzerrt sein, wenn bestimmte Gruppen in den historischen Daten unterrepräsentiert sind. Black‑box‑Modelle erzeugen Probleme bei Nachvollziehbarkeit; Regulatoren fordern daher Audit‑Logs und Erklärbarkeitsverfahren, besonders bei Entscheidungen mit großer Auswirkung auf Kundinnen und Kunden.

Systemische Risiken sind ein weiteres Thema: Konzentration bei großen Cloud‑ oder Modellanbietern kann zu Lieferantenrisiken führen, Cyberangriffe können mehrere Firmen gleichzeitig treffen, und falsche Modelle können kollektive Fehlentscheidungen bewirken. Institutionen wie ENISA und die Bank für Internationalen Zahlungsausgleich haben solche Gefährdungen benannt und empfehlen branchenweite Maßgaben für Governance und Drittanbieter‑Kontrolle.

Ein praktischer Kompromiss ist bereits verbreitet: Human‑in‑the‑Loop‑Gateways für alle automatisierten Ablehnungen oder hochwirksamen Entscheidungen, plus systematische Back‑tests, Drift‑Monitoring und dokumentierte Data‑Lineage. Solche Maßnahmen erlauben Geschwindigkeit, ohne die Kontrolle zu verlieren.

Blick nach vorn: Regelwerke, Praxis und was sich ändern könnte

Die nächste Phase wird weniger von Technik allein geprägt, sondern von Governance und Infrastruktur. Europäische Empfehlungen zielen auf nachvollziehbare Modelle, standardisierte Benchmarks für Explainability und Branchenpools mit anonymisierten Validierungsdaten. Solche Data‑Pools könnten helfen, Verzerrungen zu erkennen und Modelle unabhängig zu prüfen.

Versicherer, Aufsicht und Wissenschaft können zusammenarbeiten, um Feldtests vergleichbar zu machen: reproduzierbare Benchmarks, verpflichtende Audit‑Protokolle und abgestimmte Meldepflichten für größere Vorfälle. Für Versicherte bedeutet das mehr Transparenz: etwa Informationen dazu, ob eine Entscheidung automatisiert erfolgte und welche Daten dabei verwendet wurden.

Praktische Schritte, die eine Rolle spielen werden, sind technische (Model Monitoring, Explainability‑Tools), organisatorische (klare Governance‑Verantwortung, Third‑party‑Risk‑Management) und regulatorische (Anforderungen an dokumentierte Entscheidungsprozesse). Auf Verbraucherseite wird es wichtig sein, Anspruch auf verständliche Erklärungen und Widerspruchsmöglichkeiten zu haben.

In der Summe lässt sich sagen: Tempo ist erreichbar, Kontrolle ist notwendig. Die kommenden Jahre werden zeigen, wie gut sich beides verbinden lässt.

Fazit

KI in Versicherungen kann Schadenbearbeitung deutlich beschleunigen und in vielen Routinefällen zuverlässige Erstschätzungen liefern. Praxisberichte und Studien aus den Jahren bis 2024 belegen Einsparpotenzial und schnellere Durchlaufzeiten, weisen aber zugleich auf Grenzen hin: erklärbare Modelle, robuste Daten und Aufsicht sind entscheidend. Wo Standardfälle automatisiert werden, bleibt menschliche Expertise für komplexe oder strittige Entscheidungen nötig. Die Balance zwischen Effizienz und Verantwortung entscheidet darüber, ob die Technologie langfristig Vertrauen schafft.

Schreibe einen Kommentar